畳み込みニューラルネットワーク(CNN)とは?画像認識に強い理由・活用事例・特徴・ディープラーニング他手法との関係を徹底解説!

畳み込みニューラルネットワーク(CNN)は、AI(人工知能)による画像認識の分野でよく使われる技術で、画像から様々な情報を抽出できます。 AIの中でも画像認識は...

生成AI、画像認識、AI開発企業等のAI会社マッチング支援サービス

畳み込みニューラルネットワーク(CNN)は、AI(人工知能)による画像認識の分野でよく使われる技術で、画像から様々な情報を抽出できます。 AIの中でも画像認識は...

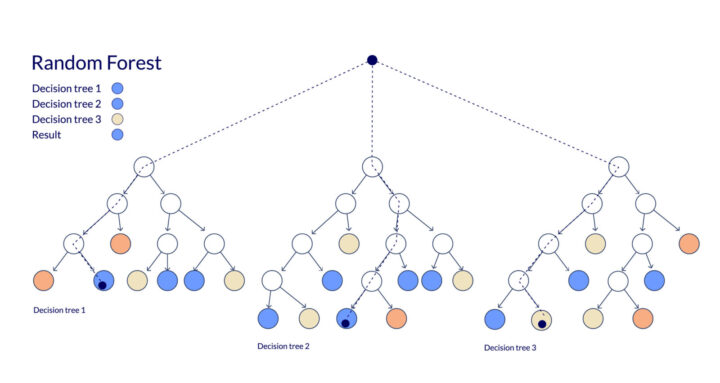

ランダムフォレストは、ビジネスの現場で日々直面する複雑なデータ分析の課題を解決する強力なツールです。 多数の決定木を組み合わせることで、従来の分析手法では見過ご...

サポートベクターマシンは教師あり学習アルゴリズムの1つで、分類や回帰といった重要なデータ分析分野に適用されます。ディープラーニング以前から使われていたモデルです...

画像認識の最前線で注目を集めるVision Transformer(ViT)。従来のCNNとは異なるアプローチで画像処理を行うこのモデルは、特に大規模データセッ...

1,600以上の言語に対応し、500以上の低リソース言語に初めてAI文字起こしを実現したオープンソースASRモデル 少数の音声サンプルで新言語を追加可能なインコ...

画像認識プロジェクトの社会実装において、ResNetは2026年現在も推論速度と投資対効果(ROI)のバランスが最も優れた標準的選択肢 残差学習(スキップ接続)...

指示文をコードに直接書き込むのではなく、ID管理されたオブジェクトとして扱うことで、プログラムの再デプロイなしに精度更新が可能に 職人の勘に頼る調整から脱却し、...

AI業界では汎用性を追求した技術開発が進んでいますが、LLM(大規模言語モデル)の開発には膨大なコストがかかるため、実際に開発できる企業は限られるのが現状です。...

基盤モデルとは、大量のデータで学習されたAIモデルであり、幅広いタスクに対応が可能で、近年は、基盤モデルを用いたAIシステムの開発が進んでいます。 本記事では今...

Gemini RoboticsはGeminiを基盤とし、ロボットが「見て、聞いて、考え、計画し、実行する」ことを可能にする自律化のためのAIモデル群 あいまいな...