ChatGPTに「学習させない」オプトアウト設定とは?機密情報を漏洩させないための手順やメリットを徹底解説!

最終更新日:2025年08月21日

記事監修者:森下 佳宏|BizTech株式会社 代表取締役

- ChatGPTのオプトアウト設定は、入力した情報がAIの学習に利用されることを防ぎ、企業の機密情報や個人情報の漏洩リスクを軽減する重要な機能

- ウェブ版ChatGPTでは手動でのオプトアウト設定が必要ですが、設定するとチャット履歴が保存されなくなる点に注意が必要

- API経由や法人向けプラン(Business(旧Team)/Enterprise)では、基本的に入力データが学習に利用されることはありません。

- オプトアウト設定だけでなく、入力情報の事前確認、社内ルールの整備と従業員教育、Azure OpenAI Serviceのようなセキュリティレベルの高い選択肢を検討するなどが求められます。

ChatGPTの導入を検討されている方は、「自社の機密情報や個人データがAIの学習に使われてしまうのでは?」と不安を感じていませんか。ChatGPTには、入力した情報をAIの学習データとして利用させない「オプトアウト設定」が用意されています。

この記事では、ChatGPTに入力した情報を学習データとして利用させないための「オプトアウト設定」について、その具体的な手順から、API利用時や法人向けプランにおける扱いの違い、設定時の注意点までを詳しく解説します。

LLMに強い会社・サービスの選定・紹介を行います

今年度LLM相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

・GPT、Claude、Gemini、Llama等の複数モデルに対応

完全無料・最短1日でご紹介 LLMに強いAI会社選定を依頼する

自分でChatGPTの導入に強いAI開発会社を探したい方はこちらの記事で特集していますので併せてご覧ください。

目次

ChatGPTを「学習させない」オプトアウト設定とは?

ChatGPTのオプトアウト設定とは、ユーザーが入力した情報をOpenAIのAIモデルの学習データとして使用しないよう指定できる機能です。このオプトアウト機能を有効にすることで、自分の入力情報がAIの学習に使われることを防ぐことができます。

ChatGPTをはじめとするLLM(大規模言語モデル)は、インターネット上の膨大なテキストデータを学習することで人間のように自然な文章を生成したり、質問に答えたりする能力を獲得しています。さらに、ユーザーとの対話を通じて得られたデータも、モデルの応答品質向上や、より人間らしい自然な対話を実現するための貴重な学習材料として活用されることがあります。

デフォルト設定のままChatGPTを利用すると、ユーザーが入力した個人情報や機密情報などがChatGPTに学習・記録され、将来的に不特定多数のユーザーに対する回答の中でその情報が流出してしまうリスクがあります。

オプトアウト設定を行うことで、自社の情報が意図せず学習データとして取り込まれるリスクを低減できます。

API利用や法人向けプランはデフォルトでオプトアウト

API利用の場合は、デフォルトでユーザーデータが学習対象外となっています。

OpenAIの公式ドキュメントによれば、「APIを通じて提出されたデータは、組織がオプトインしない限り、サービス改善(モデルのトレーニングを含む)のために使用されることはありません」と明記されています。つまり、API経由でChatGPTを利用する場合、特別なオプトアウト申請をしなくても、入力データは自動的に学習から除外されます。

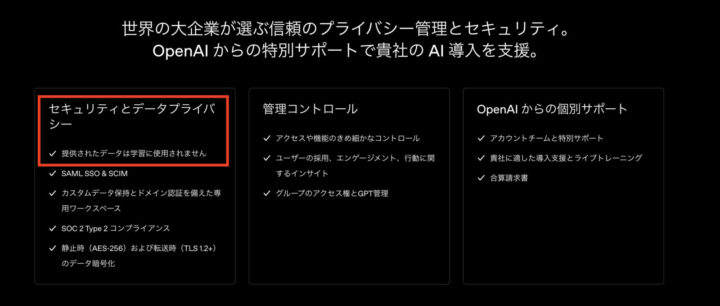

また、法人向けプランであるChatGPT EnterpriseやWorkspaceでは、標準でユーザーデータが学習に使われない設計となっています。ChatGPT Enterpriseを利用すると、「ビジネスデータをユーザー自身が所有・管理でき、お客様のビジネスデータや会話を学習に使用することはない」という特徴があります。

これは企業の機密情報保護を重視した設計であり、企業ユーザーにとって大きな安心材料となっています。

LLMに強い会社・サービスの選定・紹介を行います

今年度LLM相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

・GPT、Claude、Gemini、Llama等の複数モデルに対応

完全無料・最短1日でご紹介 LLMに強いAI会社選定を依頼する

なぜ企業はChatGPTでオプトアウト設定をして学習させないようにすべきか?

ChatGPTで「学習させない」オプトアウト設定を活用することで、業務や日常の利用において情報管理やセキュリティ面で多くのメリットが得られます。ここでは、企業が具体的に享受できる主なメリットを解説します。

関連記事:「なぜChatGPTは法人契約が必要?メリット・おすすめプラン・導入の際の検討ポイントを徹底解説!」

機密情報や個人情報の漏洩リスク軽減

オプトアウト設定を行うことで、ChatGPTに入力した内容がAIモデルの学習データとして利用されなくなります。これにより、社内の機密情報や顧客データ、個人情報などが第三者に漏洩するリスクを大幅に低減できます。

例えば、製品開発のアイデアや顧客リストなど、外部流出が許されない情報をChatGPTで扱う場合でも安心して業務に活用できるようになります。特に金融や医療、研究開発など高いセキュリティが求められる分野では、オプトアウト設定が標準的な運用として推奨されています。

関連記事:「ChatGPTで情報漏洩が起こる?リスクに対処するポイント」

データ管理・セキュリティポリシーの遵守

企業や組織では、個人情報保護法やGDPRといった各種法令・ガイドラインへの対応が求められます。オプトアウト設定を活用することで、入力データがAIの学習に利用されないため、社内外のセキュリティポリシーや法的要件を確実に遵守できます。

企業の情報セキュリティポリシーやプライバシー保護規定を遵守し、顧客や取引先からの信頼を維持するために不可欠です。個人情報保護法などの法規制への対応という観点からも重要と言えるでしょう。

実際に、顧客データや従業員情報などのセンシティブなデータをChatGPTで処理する際、この設定を徹底することでプライバシーリスクを最小限に抑えつつ、業務効率化や自動化のメリットを享受できます。

ChatGPTで「学習させない」オプトアウト設定の手順

ChatGPTで「学習させない」オプトアウト設定は、業務や日常利用で機密性やプライバシーを重視する際に欠かせない操作です。ここでは、実際にオプトアウト設定を行うための具体的な手順を紹介します。

ChatGPTの設定画面からオプトアウトを行う手順

ChatGPTのWeb版やアプリ版では、設定画面から簡単にオプトアウト設定が可能です。

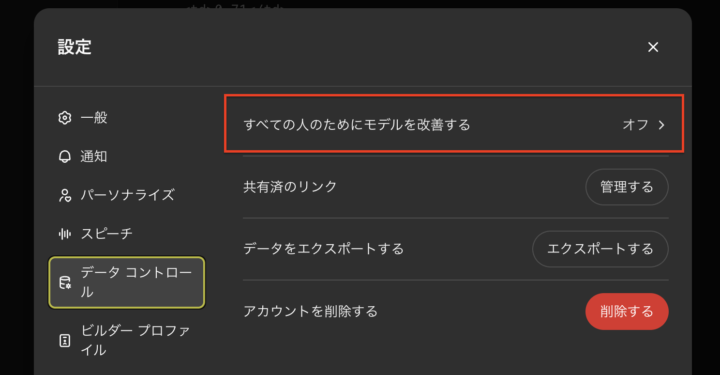

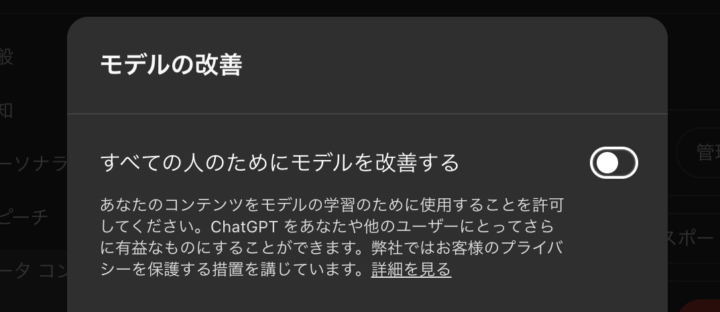

まず、ChatGPTのホーム画面左下にあるプロフィールアイコンをクリックし「Settings(設定)」を選択します。設定画面が表示されたら、「Data Controls(データコントロール)」をクリックし、「すべての人のためにモデルを改善する」をオフにしてください。

この操作により、以降の会話内容はAIの学習に利用されなくなります。

この方法は、日常的にChatGPTを利用しつつ、業務上の機密情報や個人情報が学習データに使われることを避けたい場合に有効です。なお、設定をオフにしている間のチャット履歴はAIの学習に使われませんが、履歴自体はユーザーのアカウントに保存されます。

OpenAI公式のプライバシーリクエストフォームからオプトアウト申請する手順

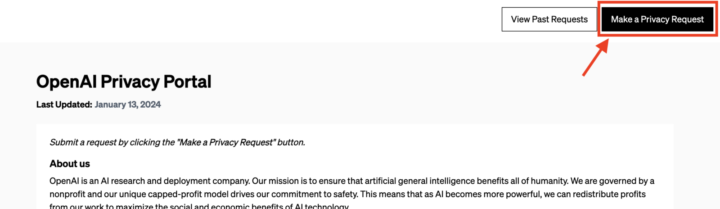

より確実に自分のデータを学習対象から除外したい場合は、OpenAIの公式プライバシーリクエストフォームを利用する方法があります。

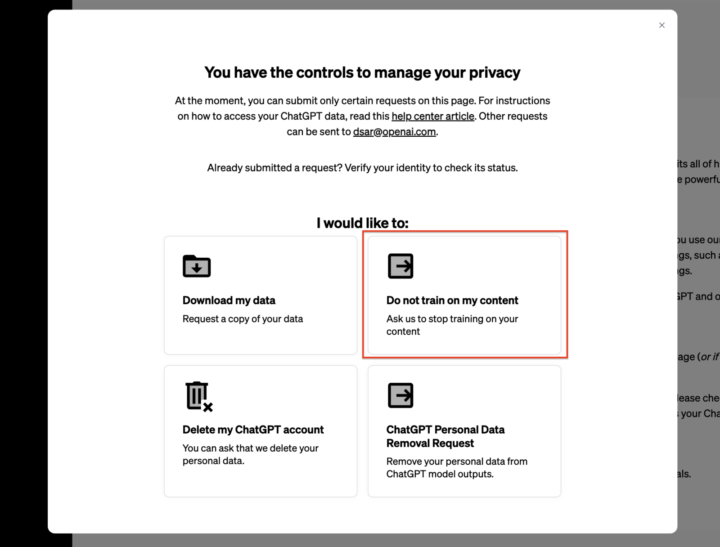

まず、OpenAI Privacy Portalにアクセスし、右上の「Make a Privacy Request」をクリックします。

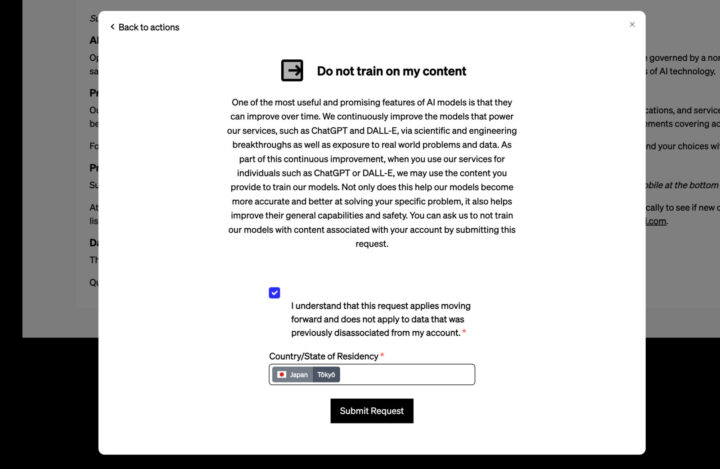

続いて「Email Address」または「Phone Number」を選択し、「Do not train on my content」をクリックします。登録時に使用したメールアドレスを入力し、「Send Email」を押すとOpenAIからメールが届きます。

そのメール内の「Log In」ボタンをクリックし、指示に従って規約への同意と居住国の選択を行い、「Confirm Request」をクリックし、「Request Submitted Successfully!」と表示されれば申請は完了です。

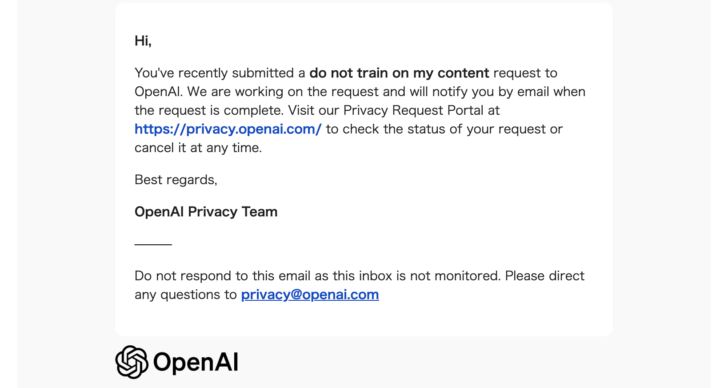

申請後、下記のようにOpenAIからオプトアウト完了の通知メールが届きます。

この手続きは、組織全体や複数アカウントで一括してオプトアウトを徹底したい場合や、より強いプライバシー管理が求められる環境で有効です。

LLMに強い会社・サービスの選定・紹介を行います

今年度LLM相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

・GPT、Claude、Gemini、Llama等の複数モデルに対応

完全無料・最短1日でご紹介 LLMに強いAI会社選定を依頼する

ChatGPTでオプトアウト設定をする場合の注意点

ChatGPTで「学習させない」オプトアウト設定を行うことで、情報漏洩リスクの軽減や法令遵守といったメリットが得られる一方、業務や日常利用の現場ではいくつかのデメリットも発生します。

ここでは、実際の利用シーンを想定しつつ、オプトアウト設定の主なデメリットについて解説します。

回答精度やカスタマイズ性の向上が期待できなくなる

オプトアウト設定を有効にすると、ChatGPTはユーザーの入力内容を学習に利用しなくなります。そのため、日々のやり取りや業務で蓄積される有意義なデータがAIの学習に反映されず、ユーザーごとの会話傾向や専門用語、業界特有の表現などをAIが覚えて最適化することができません。

結果として、個別ニーズに合わせたカスタマイズ性や、継続利用による回答精度の向上が期待できなくなります。例えば、頻繁に使う専門用語や独自のルールをAIが学習しないため、毎回同じ説明や指示が必要になるケースも考えられます。

過去のチャット履歴が利用できなくなる場合がある

オプトアウト設定を行うと、過去のチャット履歴が保存されなくなったり、履歴の一部が確認できなくなる場合があります。特に設定画面から「チャット履歴とトレーニング」をオフにした場合、以降の会話内容はAIの学習対象から除外されるだけでなく履歴自体が非表示となる仕様です。

そのため、以前のやり取りを参照しながら業務を進めたり、過去の回答を再利用したい場合には不便を感じることがあります。業務の効率化や情報管理の観点から、履歴の活用が重要な現場では、オプトアウト設定の適用範囲を慎重に検討する必要があります。

情報漏洩リスクが完全にゼロになるわけではない

オプトアウト設定を行うことで、入力データがAIの学習に利用されることはなくなりますが、情報漏洩リスクが完全にゼロになるわけではありません。

例えば、OpenAIのシステム自体に脆弱性があった場合や、不正アクセス、サイバー攻撃などが発生した場合にはオプトアウト設定の有無にかかわらず情報が流出する可能性があります。

また、ウェブ版ではオプトアウト設定後も、不正利用の監視などの限定的な目的でデータが一時的に保持・利用される可能性があります。そのため、特に機密性の高い情報を扱う際には、オプトアウト設定だけに依存せず、組織として多層的なセキュリティ対策を講じることが重要です。

オプトアウト以外の情報保護策

オプトアウト設定に加えて、企業がChatGPTを安全に利用するためには、以下のような多層的な情報保護策を講じることが推奨されます。

入力する情報の事前確認・編集

ChatGPTに入力する前に、機密情報や個人情報が含まれていないかを確認し、必要に応じてマスキングや匿名化を行う。

社内ルールの策定と周知徹底

ChatGPTの利用に関するガイドラインを作成し、従業員に遵守させます。利用目的の明確化、入力してはいけない情報の定義、相談窓口の設置などが考えられます。

また、AI利用に伴う情報セキュリティリスクについて、従業員の意識を高めるための研修を実施します。

Azure OpenAI Serviceなどよりセキュアな選択肢の検討

Microsoft Azure上で提供されるAzure OpenAI Serviceは、Azureの堅牢なセキュリティ基盤上でOpenAIのモデルを利用できます。そのため、より高度なデータ管理やセキュリティが求められる場合に有効な選択肢となります。

この場合、入力データは学習に利用されません。

LLMに強い会社・サービスの選定・紹介を行います

今年度LLM相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

・GPT、Claude、Gemini、Llama等の複数モデルに対応

完全無料・最短1日でご紹介 LLMに強いAI会社選定を依頼する

まとめ

ChatGPTの「学習させない」オプトアウト設定は、AIを活用する企業にとって、機密情報や個人データの漏洩リスクを抑え、法令遵守を徹底するための有効な手段です。Web版・アプリ版での簡単な設定や、API利用時の自動適用、さらに公式フォームによる一括申請も可能で、現場の実情に合わせた柔軟な運用が実現します。

自社の状況に合わせた最適な情報管理体制の構築や、より高度なAI活用戦略についてお悩みの場合は、専門的な知識を持つコンサルタントに相談することも有効な選択肢の一つです。

ChatGPTのオプトアウト設定についてよくある質問まとめ

- ChatGPTの「学習させない」オプトアウト設定とは何ですか?

オプトアウト設定とは、ユーザーがChatGPTに入力した情報をAIモデルの学習データとして利用されないよう指定できる機能です。この設定を有効にすることで、個人情報や機密情報がAIの精度向上のために使われることを防げます。

- オプトアウト設定のメリットは何ですか?

機密情報や個人情報の漏洩リスクを大幅に軽減できるほか、企業のセキュリティポリシーや法令遵守にも役立ちます。また、誤った情報やノイズがAIに学習されるのを防ぎ、回答品質の維持にもつながります。

- ChatGPTで「学習させない」オプトアウト設定の手順は?

利用方法によって異なります。

Web版/アプリ版ChatGPT

- 設定(Settings)を開く。

- データコントロール(Data Controls)を選択。

- 「すべての人のためにモデルを改善する」をオフにする。

OpenAI公式プライバシーリクエストフォーム

- OpenAI Privacy Request Portalにアクセス。

- 「Make a Privacy Request」から「Do not train on my content」を選択し申請。

API利用や法人向けプラン(ChatGPT Enterprise, Workspace)ではデフォルトでユーザーデータは学習に利用されません。

- ChatGPTでオプトアウト設定をする場合の注意点は何ですか?

以下の点に注意が必要です。

- 回答精度・カスタマイズ性:ユーザーの入力に基づくAIの個別最適化や精度向上が期待できなくなる可能性があります。

- チャット履歴の利用:Web版/アプリ版で設定をオフにすると、過去のチャット履歴が利用できなくなる場合があります(履歴自体が非表示になる)。

- 完全なリスク回避ではない:OpenAI側のシステム脆弱性や不正アクセス等による情報漏洩リスクが完全にゼロになるわけではありません。また、不正利用監視等の目的で一時的にデータが保持される可能性も言及されています。

- オプトアウト以外の情報保護策にはどのようなものがありますか?

以下の対策が推奨されます。

- 入力情報の事前確認・編集: 機密情報や個人情報を含まないように入力前に確認、マスキングや匿名化を実施する。

- 社内ルールの策定と周知徹底:

- ChatGPT利用に関するガイドラインを作成し従業員に遵守させる。

- AI利用に伴うセキュリティリスク研修を実施する。

- よりセキュアな選択肢の検討: Microsoft Azure OpenAI Serviceなど、セキュリティレベルの高いプラットフォームの利用を検討する(この場合、入力データは学習に利用されない)。

AI Market 運営、BizTech株式会社 代表取締役|2021年にサービス提供を開始したAI Marketのコンサルタントとしても、お客様に寄り添いながら、現場のお客様の課題ヒアリングや企業のご紹介を5年以上実施しています。これまでにLLM・RAGを始め、画像認識、データ分析等、1,000件を超える様々なAI導入相談に対応し、参加累計5,000人を超えるAIイベントを主催。AIシステム開発PM歴8年以上。AI Marketの記事では、AIに関する情報をわかりやすくお伝えしています。(JDLA GENERAL 資格保有)

▶ 監修者の実績・経歴を詳しく見る

AI Market 公式𝕏:@AIMarket_jp

Youtubeチャンネル:@aimarket_channel

TikTok:@aimarket_jp

運営会社:BizTech株式会社

掲載記事に関するご意見・ご相談はこちら:ai-market-contents@biz-t.jp