Google DeepMind、1枚の画像から3D環境を生成する「Genie 2」を発表。AIエージェントの訓練環境を大幅に拡充へ

最終更新日:2025年12月24日

記事監修者:AI Market ニュース配信チーム

Google DeepMindは2024年12月4日(現地時間)、1枚の画像からリアルタイムにインタラクティブな3D環境をシミュレート可能な基盤モデル「Genie 2」を発表した。

このモデルは、入力画像を基にして人間やAIエージェントがキーボードとマウスで実際に操作可能な3D環境を生成する。

従来のワールドモデルが特定のドメインに限定されていた中で、Genie 2は2D環境を生成していた前モデルから大きく進化し、操作に応じたフレーム生成、物理演算、複雑なキャラクターアニメーション、他のエージェントの振る舞いまでをリアルタイムでシミュレート可能だ。

<本ニュースの10秒要約>

- 1枚の画像からインタラクティブな3D環境をリアルタイム生成し、最大1分間の一貫したシミュレーションを実現

- キーボードとマウス操作に応じてフレームを生成し、物理演算やNPCの振る舞いまでをリアルタイムでシミュレート

- AIエージェントが実際に操作可能な訓練環境を無制限に生成し、より汎用的なAI開発の基盤を確立

3D環境シミュレーションを変える技術的特徴

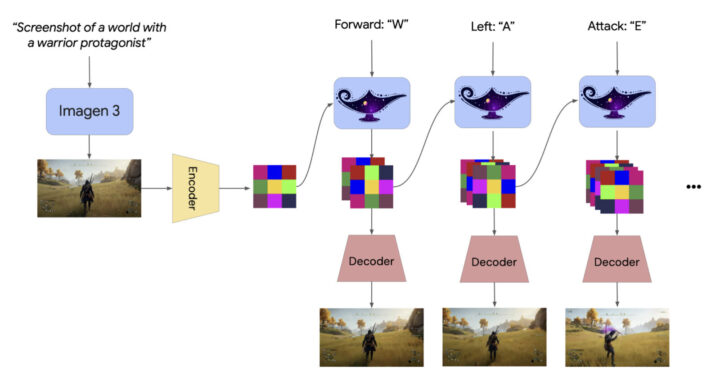

Genie 2は、大規模な動画データセットで訓練された自己回帰型潜在拡散モデルだ。入力画像はオートエンコーダーを通過後、大規模言語モデルと同様の因果マスクを使用したトランスフォーマー動力学モデルに入力される。

リアルタイムシミュレーション時には、ユーザーの操作とこれまでの潜在フレームを入力として、次のフレームを自己回帰的に生成する。アクション制御性を向上させるため、クラスフリーガイダンスを採用している。

多様なシミュレーション機能と応用可能性

本モデルは、キーボード操作に対する適切な応答、視界外の環境の記憶と再現、重力や水の動きなどの物理演算、照明効果、反射など、多岐にわたる機能を実装している。

さらに、コンセプトアートや図面からインタラクティブな環境を生成できる機能は、アーティストやデザイナーのプロトタイピングプロセスを加速させる可能性を持つ。

AIエージェント訓練への革新的アプローチ

Genie 2は、AIエージェントが実際に操作可能な訓練環境を無制限に生成できる。

例えば、SIMAエージェントを使用した実験では、Genie 2が生成した未知の3D環境でも自然言語指示に従って探索や操作が可能なことが示されている。

以下の動画では、「赤いドアを開けてください」というプロンプトでエージェントが動いていることがわかる。

AI Market の見解

Genie 2は、画像生成やビデオ生成とは一線を画す、インタラクティブな3D環境シミュレーションの画期的な進展だ。

単一のモデルで操作に応じたリアルタイムフレーム生成から物理演算、他エージェントの行動までをシミュレートできる点が特に革新的である。

この技術は、ゲーム開発のプロトタイピングを効率化するだけでなく、自動運転やロボット工学などの実世界応用に向けたシミュレーション環境の構築にも大きな影響を与える可能性がある。ただし、現状では1分程度の短い環境生成に限られ、シミュレーションの一貫性にも改善の余地がある。

より長時間の安定したシミュレーションと、生成環境の物理的整合性の向上が実用化への重要な課題となると想定される。

参照元:Google DeepMind

AI Market ニュース配信チームでは、AI Market がピックアップするAIや生成AIに関する業務提携、新技術発表など、編集部厳選のニュースコンテンツを配信しています。AIに関する最新の情報を収集したい方は、ぜひ𝕏(旧:Twitter)やYoutubeなど、他SNSアカウントもフォローしてください!

𝕏:@AIMarket_jp

Youtube:@aimarket_channel

TikTok:@aimarket_jp

過去のニュース一覧:ニュース一覧

ニュース記事について:ニュース記事制作方針

運営会社:BizTech株式会社

ニュース掲載に関するご意見・ご相談はこちら:ai-market-press@biz-t.jp