プロンプト管理とは?生成AIの出力を安定化する手順、ツール、設計時の注意点を徹底解説!

最終更新日:2026年03月25日

記事監修者:森下 佳宏|BizTech株式会社 代表取締役

- プロンプト管理とは「良いプロンプトを書く技術」ではなく、変数・モデル・評価結果・更新履歴を含めた実行環境ごと一体で管理し、再現性・保守性・拡張性を継続的に担保する組織的プロセス

- 導入フェーズはPoC・部門利用・全社展開・本番運用の4段階に分かれており、各段階で求められる管理水準が異なる

- ツール選定・設計時のポイントは「本文と前提条件を切り離さない」「運用負荷をリスク区分に応じて適正化する」「プロンプトインジェクション等LLM固有のセキュリティリスクを設計段階で織り込む」の3点

生成AIの業務活用が進む中で、成果を左右する重要な要素として注目されているのがプロンプト管理です。優れたモデルを導入しても、プロンプトが属人的に運用されていれば、出力品質は安定せず、改善も積み上がりません。

特に企業における業務利用では、再現性・統制・コスト管理・セキュリティを踏まえた体系的なプロンプト管理が必須です。

本記事では、プロンプト管理の定義とプロンプトエンジニアリングとの違いから始め、PoC・部門利用・全社展開・本番運用という4つのフェーズごとの具体的な管理方法、PromptLayerやLangfuse・AWS Bedrock・Azure AI Foundryなど代表ツール7選の特徴と選定基準、そして設計時に陥りやすい再現性の欠如・形骸化・セキュリティリスクへの対処まで解説します。

LLM×RAGに強い会社の選定・紹介を行います

今年度RAG相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

完全無料・最短1日でご紹介 LLM×RAGに強い会社選定を依頼する

LLM・RAGの活用に強いAI開発会社をご自分で選びたい方はこちらで特集していますので併せてご覧ください。

目次

プロンプト管理とは?

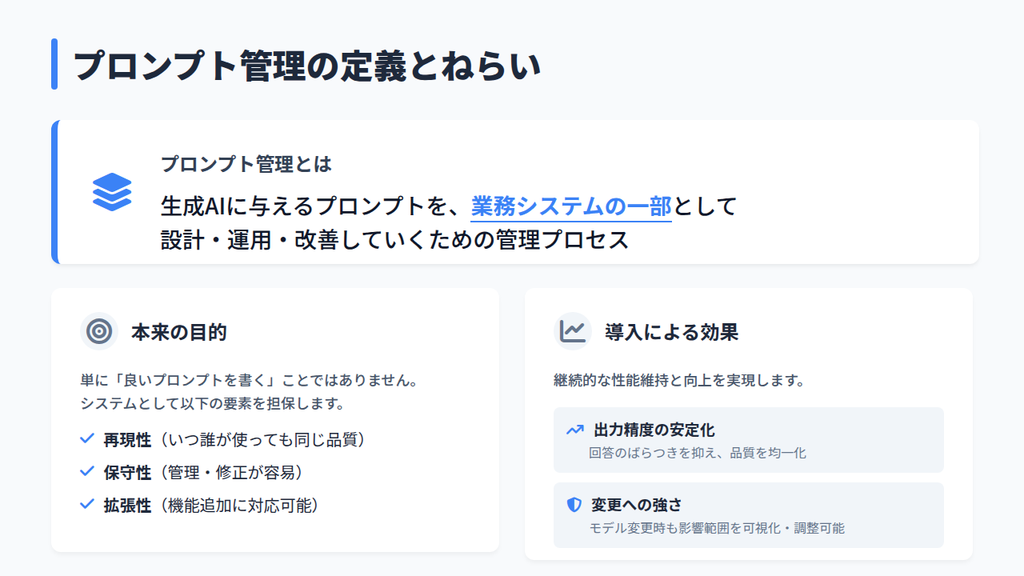

プロンプト管理とは、生成AIに与えるプロンプトを、業務システムの一部として設計・運用・改善していくための管理プロセスを指します。ここでの目的は良いプロンプトを書くことではなく、再現性・保守性・拡張性を担保しながら継続的に性能を維持・向上させることにあります。

プロンプト管理では、プロンプトそのものだけでなく、以下のような周辺情報までを含めて一元的に扱います。

- 変数の定義

- 利用シーン

- 対象モデル

- パラメータ

- 評価結果

- 更新履歴

これにより、出力精度のばらつきを抑え、モデル変更や業務要件の変化が生じた場合でも、影響範囲を可視化したうえで調整できるようになります。

生成AIを個別ツールとして使う段階を超え、業務システムとして組織的に運用する段階に進むには、プロンプトをコードや設定ファイルと同様の管理対象として扱う体制が不可欠です。

プロンプト管理を行わない場合に起こり得る問題

プロンプト管理を実施せずに生成AIを利用すると、短期的には成果が出ているように見えても、中長期的には運用・品質・ガバナンスの各面で深刻な問題を引き起こします。具体的に起こり得る問題は、以下の通りです。

| 問題 | 内容 | 業務・組織への影響 |

|---|---|---|

| 出力精度が安定しない | 同じ業務でもプロンプトが異なり、回答の粒度や正確性にばらつき | 信頼性が低下し、AI活用そのものへの不信感が広がる |

| 再現性が確保できない | 過去のプロンプトの条件や前提が記録されておらず、再利用できない | 改善が積み重ならず、PoC止まりで本番運用に進めない |

| 属人化が進む | 特定の担当者しかプロンプトの意図や調整を理解していない | 担当者の異動・退職時に運用が破綻するリスクが高まる |

| モデル変更時の影響範囲が不明 | 使用モデルやパラメータが紐づいて管理されていない | 品質劣化や不具合が発生しても原因特定が困難 |

| 改善判断の根拠が曖昧 | 出力評価が主観的で、過去との比較ができない | 投資対効果を説明できず、経営判断に耐えることができない |

| APIコスト増大の把握不足 | プロンプトごとの利用頻度やトークン消費量が追跡されていない | 想定外のコスト増加や予算超過が発生しても発見が遅れる |

| セキュリティ・ガバナンス上のリスク | 機密情報を含むプロンプトが無秩序に共有・保存される | 情報漏えいや内部統制上の問題が顕在化する |

プロンプト管理を行わない状態は、生成AIを便利なツールとして個別に利用している段階に留まり、業務システムとしての信頼性を確保できません。

特に「再現性の欠如」と「属人化」は、生成AIへの投資判断を行う経営層が最もリスクとして認識すべき問題であり、早期に管理体制を整えることが後工程のコストを大きく左右します。

生成AIを組織的に活用し、継続的に価値を生み出すためには、プロンプトをコードや設定ファイルと同様に管理対象として扱うことが不可欠です。

プロンプトエンジニアリングとプロンプト管理の役割の違い

プロンプトエンジニアリングは、生成AIから望ましい出力を得るためにプロンプトの書き方や構造を工夫・改善する技術的アプローチです。一方でプロンプト管理は、プロンプトを継続的に運用・改善するための仕組みやプロセスを指します。

企業利用においては、個々のプロンプトの出来栄え以上に、それらをいかに再利用し、検証し、標準化できるかが重要になります。

そのため、プロンプト管理では以下のような管理プロセスが求められます。

| プロンプト管理のプロセス | 内容 |

|---|---|

| プロンプトの変数化とテンプレート化 | 固定文として書くのではなく、業務ごとに変動する要素を変数として切り出し、テンプレートとして管理する |

| バージョン管理とGitOps連携 | プロンプトの変更履歴をGit管理し、Pull Requestベースのレビューフローで変更意図・承認者・差分を追跡可能にする 問題発生時はUIから即座にロールバックできる体制も含む |

| A/Bテストによるバリアント比較 | 複数のプロンプトバージョンを並行稼働させ、出力品質・コスト・レイテンシを比較することで、改善の根拠をデータで担保する |

| 回帰テストの導入 | プロンプトを変更した際に、既存業務への影響を確認するテストを実施する CI/CDパイプラインに組み込むことで変更のたびに自動検証が走る体制を構築できる |

| 出力評価の構造化(LLM-as-a-judge) | 別のLLMを評価者として用い、出力品質を一定の基準でスコアリングする 人手アノテーションと自動評価を組み合わせることで、大量の出力を継続的に検証できる |

| メタデータの付与 | 使用したモデル・パラメータ設定・実行回数・APIコストなどをプロンプトと紐づけて記録する |

このように、プロンプト管理はプロンプトエンジニアリングを内包しつつ、業務利用を前提とした統制・再現・改善の仕組みまでを含んでいます。

LangSmithやLangfuseといった現在の主要ツールは、エンジニアリングと管理の双方を単一プラットフォームで統合する方向に進化しており、両者の境界は実装レベルでは曖昧になりつつあります。重要なのは技術的な定義の区別より、「プロンプトをどう組織資産として管理するか」という運用設計の視点です。

LLM×RAGに強い会社の選定・紹介を行います

今年度RAG相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

完全無料・最短1日でご紹介 LLM×RAGに強い会社選定を依頼する

【段階別】生成AIの導入から実装までにおけるプロンプト管理方法

生成AIの活用は、検証段階から本番運用に至るまで、段階ごとに求められるプロンプト管理の水準が異なります。ここでは、フェーズごとのプロンプト管理方法について解説します。

検証・PoC段階:後から振り返れる最低限の記録を整える

検証・PoC(概念実証)の段階におけるプロンプト管理は、最適解を早く見つけることが目的になります。業務要件がまだ固まり切っていないケースも多いため、厳密な統制よりも、後から振り返れる最低限の管理が重要です。

具体的には、業務に対してどのような意図でプロンプトを設計したのかを記録し、成功・失敗のパターンを残すことが求められます。プロンプトを個人のチャット履歴に閉じ込めるのではなく、テンプレートとして共有可能な形にしておく必要があります。

この段階で整備しておきたい管理項目は以下の通りです。

- 使用モデルとパラメータ

- 想定する入力と期待する出力

- 試行したプロンプトのバリエーションと結果

- 設計意図と改善の判断理由

ツールとしては、Langfuse(OSSで無料・セルフホスティング可能)やPromptLayerのような軽量な管理・ログ記録ツールをPoC段階から導入しておくと後続フェーズへの移行コストを大幅に下げられます。

完璧な管理体制は不要ですが、検証結果が再利用できる形で残っているかどうかがこのフェーズの評価基準です。どのツールが自社環境に適しているか、あるいはそもそもPoC段階でどこまで整備すべきかの判断に迷う場合は、類似案件の実績を持つ専門家への相談が有効です。

AI Marketでは、生成AIのPoC支援から本番導入まで対応できる開発会社を、要件整理のうえで無料で紹介しており、1,000件以上の相談実績から自社フェーズに合った進め方のアドバイスを受けることができます。

部門利用・業務試験段階:複数人・複数業務での安定利用を実現する

部門利用・業務試験の段階では、PoC段階で得られた知見をもとに、複数の担当者が同質の出力を得られる状態を作ることが目的です。

まず、PoC段階で個別に最適化されたプロンプトをそのまま使い回すのではなく、業務目的ごとにテンプレート化します。担当者ごとの解釈違いによる出力のばらつきを抑えるためには変数と固定文を分離したテンプレート形式での共有が有効です。

この段階から導入すべきプロセスは以下の通りです。

- 簡易的なバージョン管理:どの変更がいつ・誰の判断で行われたかを記録し、問題発生時に原因を特定できる状態にする

- A/Bテストによるバリアント比較:複数のプロンプトバージョンを並行稼働させ、出力品質・トークンコスト・レスポンス速度を比較しながら改善の根拠をデータで担保する

- LLM-as-a-judgeの試験的導入:人手レビューに加えて別のLLMを評価者として使い、出力品質を一定基準でスコアリングする仕組みを小規模に試す

この段階での管理不足は、全社展開時に品質問題が一気に顕在化する原因になります。部門内での運用が軌道に乗る前に管理プロセスの骨格を整えておくことが後工程のコストを抑えることに直結します。

次フェーズへの移行判断:複数部門にまたがる利用が想定され、プロンプトの標準化・承認プロセスの整備が必要になった時点が目安です。

全社展開・標準化段階:ガバナンスと品質管理を組織設計として整える

全社展開・標準化の段階では、生成AIは組織全体の業務基盤として利用されるようになります。このフェーズにおけるプロンプト管理では、品質と統制を両立させながら、誰が使っても一定の成果が得られる状態を維持することが重要です。

具体的には以下の取り組みが必要です。

- プロンプトライブラリの整備:用途別・業務別に正式なテンプレートを定義し、組織全体で参照できるプロンプトハブとして運用する。

利用可能な範囲と禁止事項を明文化し、意図しない使い方を防ぐ - GitOpsベースの承認フロー:誰が・なぜ・どう変更したかの文脈がコードと同じ形で記録される

- 部門横断での評価基準の統一

この段階では、プロンプト管理は技術的取り組みというよりも、ガバナンスや内部統制の一部として位置づけられます。経営層への報告やコンプライアンス対応においても管理プロセスの整備状況が問われる場面が増えてきます。

次フェーズへの移行判断:プロンプトがアプリケーションに組み込まれ、コードと同一のデプロイ・監視体制での管理が必要になった時点が目安です。

システム実装・本番運用段階:安定稼働と継続的改善をCI/CDで支える

システム実装・本番運用の段階では、プロンプトはアプリケーションコードや設定情報と同様に本番環境に耐えられるようにならなければいけません。このフェーズにおけるプロンプト管理では、安定稼働と継続的な改善を両立させながら、業務影響やリスクを最小限に抑えることが目的です。

実装面では以下の体制が必要です。

- 環境分離:開発・検証・本番の各環境を分離

- デプロイ管理:意図しない変更が即座に業務へ反映されない仕組みを整える。

- CI/CDパイプラインへの回帰テスト組み込み:PromptfooなどのCLIツールを使い、プロンプト変更のたびに既存業務への影響を自動で検証するテストをパイプラインに組み込む。

- 継続的な運用監視:HeliconeやLangSmithのようなオブザーバビリティツールを活用し、想定外の挙動が発生した場合に原因を迅速に特定できる体制を整える

- インシデント対応フローの整備

本番運用段階では、出力精度に加えてコスト・セキュリティ・可用性の観点が経営課題として浮上します。プロンプト管理はここで初めて、技術チームだけの課題から組織全体のリスク管理の一部へと昇格します。

継続的改善サイクルを維持するための設計が、生成AIへの投資を長期的に正当化する基盤になります。

プロンプト管理に役立つツール

プロンプト管理を組織的に実践するには、手作業による記録やスプレッドシート管理だけでは限界があります。特に企業利用では、以下のような機能を統合的に扱える環境が求められます。

- バージョン管理

- ログ取得

- 評価

- アクセス制御

- コスト可視化

ツールを選定する際は、単にプロンプトを保存できるかではなく、以下のような観点が必要です。

- 既存の開発基盤やクラウド環境とどの程度統合できるか

- 監査や内部統制に対応できるか

- 複数部門での共同利用に耐えられる設計になっているか

以下では、プロンプト管理を高度化するための代表的なツールを紹介します。

PromptLayer

PromptLayerは、生成AIのプロンプトをチームで管理・追跡・評価・共有するためのプラットフォームです。プロンプトをコードから分離し、テンプレート化やバージョン管理といった業務品質の担保に必要な機能を提供します。

PromptLayerでは、プロンプトをテンプレートとして登録し、複数バージョンを管理できるため、バージョンの使用履歴を把握できます。また、環境ごとに本番・開発ラベルを付与したり、A/Bテストやリグレッションテストを自動化したりすることで、出力精度の比較や回帰の検出も可能です。

さらに、OpenAI・Anthropicなど複数のLLMプロバイダーに対応するモデル非依存の設計を採用しており、プロンプトごとの使用状況・コスト・レイテンシの分析もサポートしています。

組織的なプロンプト管理の第一歩として導入しやすく、属人的な調整からの脱却を支える管理基盤として機能します。

PromptHub

PromptHubは、チームや組織でのAIプロンプト管理・共有・最適化を目的としたプラットフォームです。PromptHubを用いることで、散在しがちなプロンプトを一元化し、バージョン管理や共同編集、評価・比較といった企業利用で求められる機能を備えた環境として活用できます。

PromptHubの特徴は、Gitのようなバージョン管理ワークフローをプロンプトに適用できる点です。これにより、変更履歴の追跡やブランチ・マージといった開発現場になじみのあるプロセスの中でプロンプト運用が進められます。

また、WebベースのUIから複数のモデルに対するテスト比較やサイドバイサイド評価も可能で、OpenAI・Anthropic・Azureなど主要なLLMプロバイダーへのクロスモデルテストにも対応しています。

本番運用を見据えた機能として、REST APIエンドポイントを通じて最新プロンプトバージョンを取得・変数注入・アプリケーションへ直接デプロイできる「プロンプト・アズ・ア・サービス」構成が取れます。

さらに、guardrailsを組み込んだCI/CDパイプラインにより、シークレット漏えいや性能劣化のあるプロンプトを本番デプロイ前に自動でブロックする仕組みも備えています。

チーム内で共有ライブラリを構築し、テンプレート化されたプロンプトを循環させることで部門間のばらつきを防ぎ、標準化されたAI活用が実現できます。

Langfuse

Langfuseは生成AIアプリケーションの品質管理全般を支えるオープンソースのプラットフォームであり、プロンプト管理もその中核機能の一つとして提供されています。プロンプトを業務アセットとしてバージョン管理・編集・評価できる仕組みを備えています。

Langfuseのプロンプト管理機能では、専用のダッシュボード上でプロンプトを一元管理し、バージョンごとの変更履歴を自動で記録できます。これにより、どのバージョンがどの環で使われているかを明確にし、ロールバックや比較、A/Bテストを実施できます。

2025年6月には全機能がOSSとして無料開放されており、セルフホスティングも容易に行えます。データを自社インフラ内で完結させたい企業にとって特に有力な選択肢です。

プロンプト管理機能では、ダッシュボード上でバージョンごとの変更履歴を自動記録し、ロールバック・A/Bテスト・LLM-as-a-judgeによる自動評価を一体的に扱えます。GitHubとの連携によってプロンプトをコードと同じPull Requestベースのレビューフローで管理し、問題発生時はUIから即座にロールバックできる体制を構築できます。

出力トレースやコスト情報と統合されているため、どのプロンプトがどのような経緯で良い・悪い応答を生んだかを可視化しながら改善できます。セキュリティ・コンプライアンスを重視する企業環境での採用実績も豊富で、SOC 2・ISO 27001に準拠したクラウド版も提供されています。

AWS Bedrock Prompt Management

AWS Bedrock Prompt Managementは、AWSが提供する生成AIプラットフォームに統合されたプロンプト管理機能です。Bedrockは複数の基盤モデルを統一APIで利用可能なサービスであり、AI運用の統制・再現性・改善を支えます。

最大3バリアントのプロンプトをサイドバイサイドで比較検証でき、作成者・部署といったメタデータを付与した内部統制対応の管理が可能です。

2025年には「Prompt Optimization」機能が一般提供(GA)を開始しており、プロンプトを自動的に書き換えて精度向上・応答の簡潔化を図る機能として利用できます。最適化前後のプロンプトを比較しながらPrompt Managementへの保存まで一貫して行えます。

東京リージョン(ap-northeast-1)を含む多数のリージョンで利用可能です。

Bedrock FlowsおよびBedrockエージェントとの統合により、管理中のプロンプトをRAGパイプラインやエージェントワークフローに直接組み込むことができます。

すでにAWS上でシステムを構築・運用している企業にとっては、IAM・KMS・CloudWatchといった既存のセキュリティ・監視基盤をそのまま活用できる点が他クラウドに対する優位性です。

Azure AI Foundry(Prompt Flow)

MicrosoftはAzure AI StudioをMicrosoft AI Foundryにリブランドしており、Prompt Flowは現在Azure AI Foundryの一機能として提供されています。なお、Prompt Flowはハブベースの旧プロジェクト向けの機能として位置づけられており、最新のFoundryプロジェクトでは提供方式が変わっています。

AzureエコシステムでのLLMアプリ開発を検討している場合は、最新のFoundryポータルの動向を確認することをお勧めします。

主な機能としては、プロンプトやLLMへの操作をノードとして組み合わせたワークフローを視覚的に設計・実行できます。以下を一連のフローとして管理でき、評価フローをCI/CDパイプラインに組み込むことで業務要件に対するプロンプト性能を継続的に検証する体制を構築できます。

- プロンプトのバリアント作成

- 評価比較

- メトリクス収集

AzureのエンタープライズReadiness(セキュリティ・コンプライアンス・スケーラビリティ)の枠組みのもとで生成AIを開発・運用したい企業に向いており、Microsoft 365やAzureを主軸としているシステム環境との親和性が高い選択肢です。

LangSmith

LangSmithは、LLMアプリケーションの開発・監視・評価・運用を支援するプラットフォームです。LangChainの開発チームによって提供されており、生成AIアプリケーション全体のライフサイクル管理を意識した設計になっています。

プロンプト管理に関連する機能として、バージョン管理・比較・テスト・追跡を備えています。プロンプトの履歴はコミットタグで管理でき、異なるバージョンを環境ごとに切り替えて検証・運用することが可能です。

UI上のPlayground機能を活用することで、モデル構成やテンプレートを変更しながらプロンプトを試行・検証できます。実行結果や使用したパラメータが可視化されるため、品質改善の判断根拠を得やすくなります。

トレースデータや出力ログの収集・評価を統合し、LLMアプリ全体の挙動を観測・分析する機能も備えており、精度低下や想定外の出力が発生した際の原因特定を迅速に行えます。

RAGやエージェントを含む複雑なLLMパイプラインを構築している組織での採用実績が豊富です。

Weights & Biases(W&B Weave)

Weights & Biases(W&B)は、MLOpsツールとして広く知られるプラットフォームで、近年はLLMOpsにも本格対応した製品ライン「W&B Weave」を提供しています。以下を一貫して扱える機能を備えており、機械学習モデルの実験管理とプロンプト管理を同一プラットフォームで統合したい組織に適しています。

- プロンプトの追跡

- バージョン管理

- 評価可視化

W&B Weaveでは、プロンプトをアーティファクトとして保存・追跡し、どのプロンプトがどの実験・モデルと関連しているか、どのバージョンが最適な出力を生んだかを記録・把握できます。実験ログ・ハイパーパラメータ・出力メトリクスをダッシュボードで可視化・比較する機能は、プロンプト変更の影響を定量的に評価し、A/B比較や傾向分析を行ううえでも有効です。

機械学習エンジニアがすでにW&Bを活用している組織では、既存の実験管理基盤をそのままLLMOpsに拡張できます。新たなツールチェーンの学習コストを抑えながらプロンプト管理を高度化できます。

LLM×RAGに強い会社の選定・紹介を行います

今年度RAG相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

完全無料・最短1日でご紹介 LLM×RAGに強い会社選定を依頼する

プロンプト管理システムを設計する際の注意点

プロンプト管理を本格的に導入する際は、ただツールを導入するだけでは十分ではありません。設計の段階で見落としやすい落とし穴を把握しておくことが、運用の形骸化やセキュリティリスクを防ぐ前提になります。

本文と前提条件が切り離されると再現性が失われる

プロンプト管理を設計する際に見落とされがちなのが、プロンプト本文とその前提条件を分離してしまうことによる再現性の低下です。生成AIの出力はプロンプトそのものだけでなく、以下のような要素にも強く依存します。

- 使用モデル

- システムメッセージ

- 温度や最大トークン数などのパラメータ

- 入力データの形式や文脈

本文のみを保存し、前提条件を記録していない場合、同じプロンプトを再利用しても同一の結果が得られません。この状態では、改善や比較検証が困難になり、プロンプト管理の意義そのものが失われます。

企業での本番運用を前提とする場合、プロンプトはテキストの断片ではなく、実行環境と一体化した構成要素として管理する必要があります。以下の項目をセットで保存し、どの条件下で成果が得られたのかを保存しておくことが重要です。

運用負荷が高くなりすぎるとプロンプト管理が形骸化する

プロンプト管理は重要な取り組みですが、設計を誤ると現場への負担が増大し、形骸化するリスクがあります。承認フローが複雑すぎたり、記録項目が過剰に多かったりするとローカル環境で独自にプロンプトを運用するようになり、プロンプト管理の統制は実質的に失われることになるでしょう。

特にスピードが求められる業務領域では、改善や調整を迅速に行えなければAI活用そのものが停滞します。こうした形骸化を防ぐには、変更の影響範囲に応じた管理強度の段階的な設計が有効です。

以下のような分類を基準に管理水準を決めると、実務での定着率が上がります。

| リスク区分 | 対象 | 管理水準 |

|---|---|---|

| 高リスク変更 | 本番環境に直接影響する変更 | 承認フロー・レビュー必須 変更前後の回帰テスト実施を条件とする |

| 中リスク変更 | 検証環境・部門利用 | 記録は必須だが承認は簡略化 変更意図のコメントを残す程度で対応可能 |

| 低リスク変更 | PoC・個人検証 | 変更ログの自動記録のみで承認プロセスは不要 |

このように変更リスクに応じた統制の強弱をあらかじめ定義しておくことで、必要な統制を確保しながら現場の運用負荷を許容範囲に抑えられます。

セキュリティ・アクセス権限を適切に設計する

プロンプトには業務ロジックや社内ナレッジ、場合によっては機密情報に関する指示が含まれることがあります。これらを適切に管理しなければ、情報漏えいや不正利用のリスクが高まります。

セキュリティにおいて重要なのは、プロンプトの閲覧・編集・承認・本番反映といった操作ごとに、役割ベースのアクセス制御(RBAC)を設けることです。全員が自由に編集できる状態では統制が効きませんが、逆に一部の担当者しか触れない設計では運用が属人化します。

また、プロンプトの実行ログや変更履歴を監査可能な形で保存することも重要です。誰が、いつ、どのプロンプトを変更し、どのモデルで実行したのかを追跡できるようにしておく必要があります。

加えて、LLMに固有の脅威として以下の2点は設計段階で対策を組み込む必要があります。

| 脅威 | 概要 | 有効な対策 |

|---|---|---|

| プロンプトインジェクション | 悪意ある入力でシステムプロンプトの制約を破らせる攻撃 | 入力値のサニタイズ、ユーザー入力とシステムプロンプトを明確に分離した構造設計 |

| システムプロンプト漏えい | ユーザーが巧みな指示を用いてシステムプロンプトの内容を引き出す攻撃 | 機密情報や業務ロジックの直接埋め込みを避け参照先を外部に置く構成、テスト段階での漏えい確認の習慣化 |

さらに、外部APIとの連携やクラウド環境での運用では、APIキーの管理・ネットワーク制御・データの暗号化といった基本的なセキュリティ対策も前提となります。プロンプト管理のセキュリティ設計は、AI固有のリスクと一般的なシステムセキュリティの両面から検討することが求められます。

プロンプト管理についてよくある質問まとめ

- プロンプト管理の手順は?

プロンプト管理の手順は、以下の通りです。

- 変数化・テンプレート化

- バージョン管理の導入

- 回帰テストの実施

- 出力評価の構造化(LLM-as-a-judge等)

- メタデータの記録

- 生成AIの導入フェーズによって、プロンプト管理の進め方はどう変わるのか?

フェーズごとに求められる管理水準が異なります。

- PoC段階:設計意図・成功失敗パターン・モデル・パラメータの最低限の記録。LangfuseやPromptLayerの早期導入で後工程の移行コストを下げられる

- 部門利用段階:テンプレート化・簡易バージョン管理・A/Bテスト・LLM-as-a-judgeの試験的導入

- 全社展開段階:プロンプトライブラリ整備・GitOpsベースの承認フロー・部門横断での評価基準統一

- 本番運用段階:環境分離・CI/CDへの回帰テスト組み込み・オブザーバビリティツールによる継続監視・インシデント対応フローの整備

- プロンプト管理に有効なツールは?

企業利用では、バージョン管理・評価・ログ取得・アクセス制御を備えたツールが有効です。代表的なツールは次の通りです。

- PromptLayer:テンプレート管理やA/Bテスト、コスト可視化が可能

- PromptHub:Gitライクなバージョン管理とチーム共有に対応

- Langfuse:トレースや評価機能を統合したLLMOps基盤

- AWS Bedrock Prompt Management:AWS環境と統合しやすく企業向け

- Azure AI Prompt Flow:評価フローとCI/CD的運用が可能

- LangSmith:トレース・評価・バージョン管理を統合

- Weights & Biases:実験管理と可視化に強い

- 社内にプロンプト管理の知見がなく、どのフェーズから・何のツールで始めればいいか判断できない場合、どうすればいいか?

まず自社のAI活用フェーズを確認することが出発点です。PoC段階であればLangfuseやPromptLayerのような低コストのツールから着手するのが現実的で、本番運用が見えてきた段階でCI/CDや承認フローの整備に移行します。ただし、既存システムの構成・セキュリティ要件・開発体制によって最適な進め方は大きく変わるため、独力での判断に時間がかかる場合は類似案件の実績を持つ専門家に確認するのが効率的です。AI Marketでは、プロンプト管理を含む生成AI活用全般について要件整理の段階から無料で相談でき、1〜3営業日で対応可能な開発会社を紹介しています。

まとめ

生成AIを業務で活用する企業にとって、プロンプトはもはや一時的なものではなく、資産として扱うべき要素です。プロンプト管理とは、その資産を偶然や属人性に委ねるのではなく、再現性と統制のもとで継続的に改善していくための仕組みそのものでもあるのです。

一方で、自社の開発フェーズや既存インフラに合ったツール選定、セキュリティ設計、CI/CDとの統合といった実装判断は類似案件の経験がなければ判断コストが高くなります。どのツールから着手すべきか、自社の体制でどこまで内製できるかを見極めるには実績を持つ専門家との対話が近道です。

AI Marketでは、累計1,000件以上のAI導入相談実績をもとに、プロンプト管理を含む生成AI活用の要件整理から対応可能な開発会社の紹介まで無料でサポートしています。構想がまだ固まっていない段階からでも相談を受け付けており、問い合わせ後に複数社から一斉に連絡が届く一括見積もり型とは異なるため、情報収集の入口としても活用しやすい設計になっています。

AI Market 運営、BizTech株式会社 代表取締役|2021年にサービス提供を開始したAI Marketのコンサルタントとしても、お客様に寄り添いながら、現場のお客様の課題ヒアリングや企業のご紹介を5年以上実施しています。これまでにLLM・RAGを始め、画像認識、データ分析等、1,000件を超える様々なAI導入相談に対応し、参加累計5,000人を超えるAIイベントを主催。AIシステム開発PM歴8年以上。AI Marketの記事では、AIに関する情報をわかりやすくお伝えしています。(JDLA GENERAL 資格保有)

AI Market 公式𝕏:@AIMarket_jp

Youtubeチャンネル:@aimarket_channel

TikTok:@aimarket_jp

運営会社:BizTech株式会社

掲載記事に関するご意見・ご相談はこちら:ai-market-contents@biz-t.jp