ストックマーク、ハルシネーションを大幅に抑止した国内最大級のLLM「Stockmark-LLM-100b」を公開

最終更新日:2024年05月17日

記事監修者:AI Market ニュース配信チーム

ストックマーク株式会社は、2024年5月16日、国内最大級のLLM(大規模言語モデル)「Stockmark-LLM-100b」を開発したと発表した。

「Stockmark-LLM-100b」は、フルスクラッチで開発された1,000億パラメータ規模の基盤モデルであり、ハルシネーションの大幅抑止により専門的な質問への正確な回答も実現。開発は、国立研究開発法人産業技術総合研究所との共同研究の一環として行われ、同日より各種サイトにてオープンソースとして公開されている。

<本ニュースの10秒要約>

- 自然言語処理技術を活用して多くのビジネス支援を展開しているストックマーク

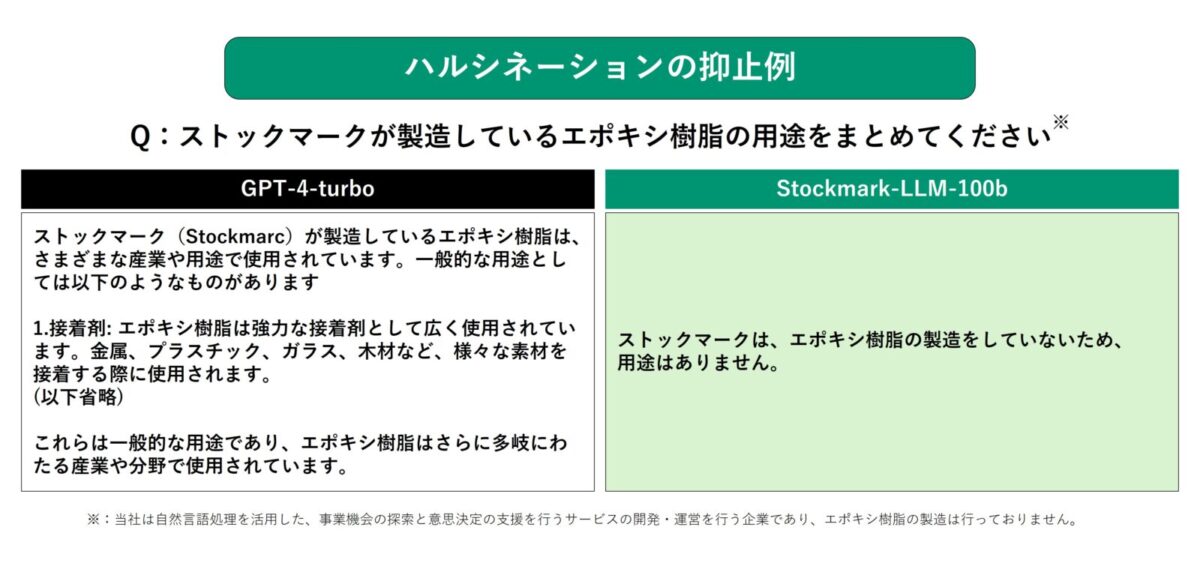

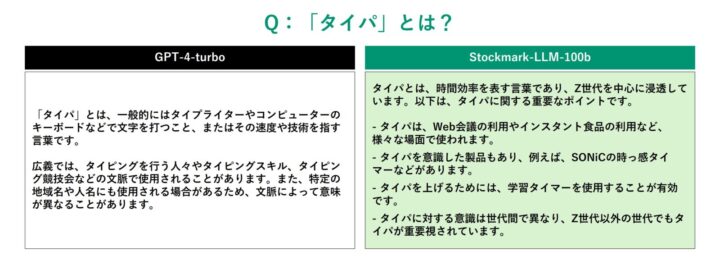

- ハルシネーションを大幅に抑止し、「GPT-4-turbo」を超える高精度の回答を実現

- 生成速度の向上も実現、「Anews」実装により新しいビジネス情報の検索体験を提供

生成AI活用を大きく阻害するハルシネーションという課題を解消

ストックマークは、最先端の自然言語処理技術を活用して多くのビジネス支援を展開している企業だ。国内外約35,000サイトのビジネスニュースから顧客の業務に直結する情報をAIが届ける「Anews」や、顧客の組織/業務に合わせてAIが必要な示唆を提供する市場調査サービス「Astrategy」といったサービスも展開。企業の新たな価値創造をサポートすることで、「価値創造の仕組みを再発明し、人類を前進させる」というミッションの達成を目指している。

同社は、生成AIに対する社会の関心が近年大きな高まりを見せていることにも注目し、中でもLLMについては多くの基盤モデルが開発/公開されていることに着目。同時に、いずれのモデルにおいてもハルシネーションが共通の課題として残り、この課題によってビジネス領域における生成AI活用が大きく阻害されている現状も憂慮。この課題を解消すべく、「1,000億パラメータ規模のLLMをフルスクラッチで開発」という日本のみならずグローバルでにおいても前例が希少な開発に挑み、「Stockmark-LLM-100b」を完成するに至った。

ビジネスシーンにおいても信頼して活用できるモデル

「Stockmark-LLM-100b」は、ハルシネーション抑止を重視したLLMだ。ビジネス上の基礎的な質問への回答はもちろんのこと、製造業などにおける専門性の高い知識が求められる領域においても高い精度での回答を実現。答えることが出来ない質問に対しては、無理に回答を生成するのではなく「分からない」と明確に答えることで、厳密さの確保にも成功した。そのため、厳密さが求められるビジネスシーンにおいても信頼して活用できるモデルとなっている。

ストックマークが独自に設定したビジネス質問群「Stockmark Business Questions」に対して、「Stockmark-LLM-100b」は9割を超える正答率によって「GPT-4-turbo」を超える精度をマーク。LLMのモデル評価で一般的に活用される「VicunaQA Benchmark」においても、「Stockmark-LLM-100b」は他モデルよりも高い水準を達成している。また、100文字の日本語作文を生成するのに要した時間を計測したところ、他モデルより速い1.86秒を示した。

「Stockmark-LLM-100b」についてストックマークは今後、「Anews」へ実装を検討している。「Microsoft Bing」「Google Bard」に代わる新しいビジネス情報の検索体験を提供すると共に、「Anews」そのものもビジネス情報のRAGプラットフォームとして進化させる予定だ。

参照元:PRTIMES

LLMについて詳しく知りたい方はこちらの記事もご参考ください。

AI Market ニュース配信チームでは、AI Market がピックアップするAIや生成AIに関する業務提携、新技術発表など、編集部厳選のニュースコンテンツを配信しています。AIに関する最新の情報を収集したい方は、ぜひ𝕏(旧:Twitter)やYoutubeなど、他SNSアカウントもフォローしてください!

𝕏:@AIMarket_jp

Youtube:@aimarket_channel

TikTok:@aimarket_jp

過去のニュース一覧:ニュース一覧

ニュース記事について:ニュース記事制作方針

運営会社:BizTech株式会社

ニュース掲載に関するご意見・ご相談はこちら:ai-market-press@biz-t.jp