プロンプト最適化とは?自動最適化する方法やメリット、代表的なツールを徹底解説!

最終更新日:2026年03月25日

記事監修者:森下 佳宏|BizTech株式会社 代表取締役

- 手動プロンプト改善は再現性・スケーラビリティ・モデル依存・主観評価という4つの構造的限界

- 自動最適化(DSPy・OpenAI Prompt Optimizerなど)を導入することで、評価指標に基づく定量的な改善サイクルが構築できる

- 評価指標の事前定義・バージョン管理・チーム共有・継続的改善サイクルの4点をセットで設計することが前提条件

生成AIを業務に取り入れる中で、思ったような出力が得られない、運用できるほどの精度が確保できないといった課題に直面するケースは少なくありません。その原因の多くは、モデル性能そのものではなく、プロンプトの設計や改善方法にあると言えるでしょう。

これまでプロンプト改善は、担当者の経験や試行錯誤に依存する属人的な作業として扱われてきました。しかし、再現性やスケーラビリティ、継続的なプロンプト管理といった観点で、手動での最適化には限界が顕在化しています。こうした課題に対する有力なアプローチが、ツールを用いたプロンプトの自動最適化です。

本記事では、手動プロンプト改善が抱える再現性・スケーラビリティの限界を具体的に整理したうえで、構造化プロンプト設計・RAG連携・プログラムによる自動最適化という3つのアプローチを解説します。

さらに、DSPy・OpenAI Prompt Optimizer・LangSmith・Langfuseなど実務で利用される代表ツール7選の特徴と使い分けの判断軸、そして成果につなげるための実務設計ポイントまでを網羅しています。

LLM×RAGに強い会社の選定・紹介を行います

今年度RAG相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

完全無料・最短1日でご紹介 LLM×RAGに強い会社選定を依頼する

LLM・RAGの活用に強いAI開発会社をご自分で選びたい方はこちらで特集していますので併せてご覧ください。

目次

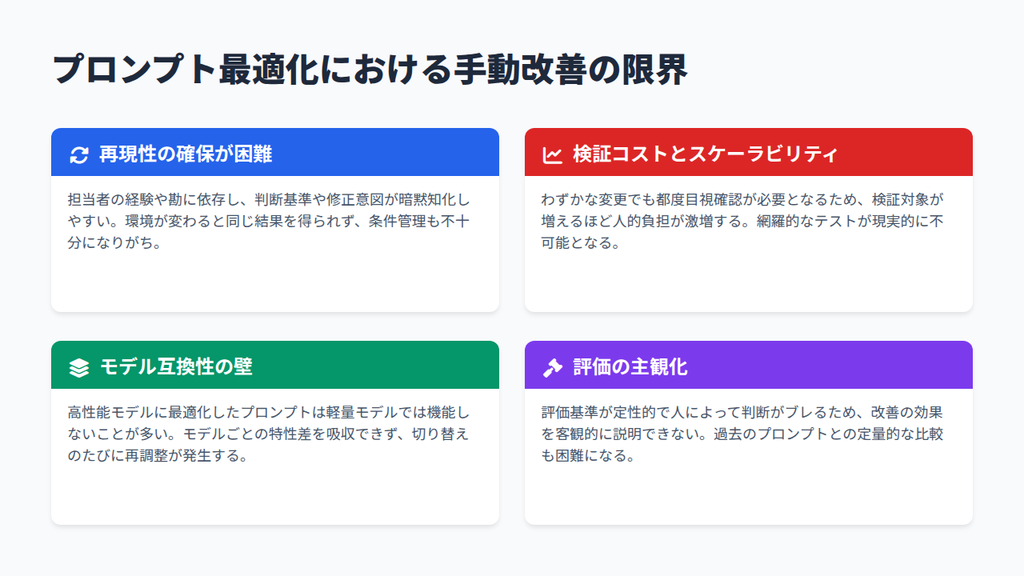

手動でのプロンプト改善が抱える問題点

生成AIを業務に組み込む企業が増える中で、プロンプトの品質はアウトプットの精度や安定性を決定づける要素となりつつあります。しかし、現場では担当者の経験や試行錯誤に依存したプロンプト改善が行われています。

手動でのプロンプト改善には、以下のような問題があります。

判断基準が属人化し、担当者交代で品質を再現できなくなる

手動によるプロンプト改善の課題として、結果の再現性を安定して確保できない点が挙げられます。担当者が試行錯誤の末にプロンプトを作成したとしても、その背景にある判断基準や修正意図が暗黙知のまま放置されてしまうと別の環境や担当者が再現することは困難です。

また、手動での改善では以下の条件を体系的に管理・記録しながら検証することが難しく、なぜ精度が向上したのか、どの変更が効果的だったのかを説明できないケースが少なくありません。

- 入力テキスト

- モデルのバージョン

- トークン制限

- 周辺システム

結果として、プロンプトが属人的なノウハウとして紐づけられ、業務としての再利用性や引き継ぎ性が低下します。

ユースケースが増えるほど、手動検証のコストが比例して膨らむ

手動でプロンプトを改善する場合、精度検証のたびに人手による調整と確認作業が発生します。わずかなテキストの変更であっても、期待する出力が得られるかをその都度実行し、結果を目視で比較・判断する必要があるため、検証コストは想定以上に膨らんでしまうでしょう。

特に業務用途では、多数のユースケースやデータパターンを前提とするため、検証対象が増えるほど人的負担は増加します。

さらに、プロンプト改善を継続的に行うためには、モデルの更新や業務要件の変更に応じて再検証が必要です。しかし、すべてのケースを網羅的に検証することが現実的ではなく、検証範囲を限定せざるを得ません。

その結果、テストケースでは動作していても、本番環境では想定外の出力が発生するリスクが残ります。

高性能モデル向けのプロンプトが、軽量モデルへの切り替えで精度を維持できない

手動で作成・調整されたプロンプトは、特定のLLMを前提に最適化されている状態であるため、モデルが変わると同じ性能を維持できないという問題があります。高性能なLLMで成立していたプロンプトを、そのまま軽量・高速なモデルに適用した場合、出力の一貫性や論理性が低下してしまいます。

大規模モデルは文脈理解力や推論能力に余裕があるため、多少曖昧な指示や冗長な表現でも意図を汲み取って出力できます。一方で、軽量モデルは計算資源やパラメータ数に制約があるため、プロンプトの構造や情報の与え方に対する感度が高く、同じ書き方では期待した精度が出力されにくくなります。

手動による改善では、このようなモデルごとの差異を吸収することが難しく、結果としてモデル切り替えのたびに再調整が必要になります。この問題は、コスト最適化やレイテンシ削減を目的にモデルを使い分けたい実務環境において、特に顕在化するでしょう。

評価軸が定まらないまま改善を続けると、何が効いたのか説明できなくなる

手動でプロンプトを改善するプロセスでは、出力結果の良し悪しを人の目で判断する場面が多くなります。その際、定性的な基準に依存しやすく、評価軸が明確に定義されないまま改善が進むことが少なくありません。

複数の担当者が関わる場合、同じ出力に対しても評価が分かれるケースが発生します。このような状態では、どのプロンプトが適切に改善されたのかを客観的に説明することが難しくなり、意思決定の根拠が不透明になります。

また、評価が曖昧なままでは、過去のプロンプトと新規プロンプトを定量的に比較することもできません。

結果として、改善が適切なのか、それとも表現を変えているだけなのかを検証できず、プロンプト最適化が属人的な作業に留まってしまいます。

プロンプト最適化を行う3つの方法

手動によるプロンプト改善・最適化の限界を踏まえると、プロンプトは書き方の工夫だけでなく、設計・検証・改善を含む技術的な最適化対象として捉える必要があります。以下では、代表的なプロンプト最適化の方法を解説します。

構造化プロンプト

構造化プロンプト設計は、プロンプト最適化における基盤的なアプローチです。プロンプトを構成する要素——役割・入力条件・制約・期待する出力形式——を分解して明示することで、LLMが解釈すべき情報の範囲と優先順位が明確になり、出力のばらつきを抑えやすくなります。

この設計の上に乗せる形で、目的別の誘導技術が存在します。

Chain-of-Thought(CoT)はモデルに段階的な推論プロセスを踏ませる技術で、複雑な条件分岐や多段階の判断が必要な業務タスクに有効です。一方、Few-Shot(フューショット)は入出力の例を複数提示することで、企業固有のフォーマットや判断基準をモデルに学習させる技術です。

この二つは「構造化」とは異なる次元の手法であり、構造化された土台の上に組み合わせて使うことで効果を発揮します。

業務用途では、入力と出力の関係を構造として固定化し、CoTやFew-Shotを組み合わせることで、担当者が変わっても一定の再現性を確保しやすくなります。まずここが整備されていない状態で自動最適化に進んでも、効果は限定的になります。

RAGとの連携

RAG(検索拡張生成:Retrieval-Augmented Generation)は、ユーザーの入力に応じて外部データベースや文書から関連情報を取得し、その内容をプロンプトに組み込んだ上でLLMに渡す設計パターンです。モデル内部の知識に依存せず、最新かつ業務固有の情報を前提とした生成が可能になります。

プロンプト最適化の文脈でRAGが重要なのは、取得した情報をどうプロンプトに組み込むかの設計次第で出力品質が大きく変わるからです。以下パラメータを変えるだけで、同一モデルでも回答の一貫性や正確性が変化します。

- 検索件数

- チャンクの粒度

- コンテキストの配置順序

- 情報の区切り方

RAGを導入した後に「精度が出ない」と感じるケースの多くは、プロンプト設計側の問題である場合が少なくありません。

さらに近年は、エージェントがクエリを自律的に分解・再検索しながら回答を生成する「Agentic RAG」も実用化が進んでいます。このような複数ステップの動的なプロンプト構成は手動で調整し続けることが難しく、評価・改善の自動化が一層求められます。

プログラムによる自動最適化

プログラムによる自動最適化では、プロンプトを人が文章として調整する対象ではなく、評価関数に対して最適化される構成要素として扱います。以下ステップを繰り返すことで、再現性のある改善サイクルを構築します。

- テストケース(入力データ)と評価指標を定義

- 複数のプロンプト候補を自動生成・実行

- スコアリング

- より高いスコアを得る構造へと探索・更新

このアプローチが実務で価値を持つのは、「一度うまくいく」ではなく「多数のケースで安定して成立する」品質が求められるからです。人の手による調整では検証コストが改善対象の増加に比例して膨らむのに対し、自動最適化はテストケースと指標に基づいて一括評価できるため、改善判断の根拠が明確になり、性能劣化の早期検知も可能になります。

代表的なフレームワークであるDSPy(スタンフォード大学発)は、2025年6月にv3.0をリリースし、用途に応じた複数のオプティマイザーを整備しています。

また、LangChainが提供する「Promptim」のように、LangSmith上のデータセットに対してLLMがプロンプトを自動でチューニングするシンプルなツールも普及しており、本格的なフレームワーク導入の前段階として試しやすい選択肢もあります。

オプティマイザーの選択はデータ量・タスク複雑度・最適化コストのバランスによって異なるため、小規模なテストから段階的に導入するのが現実的なアプローチです。どのフレームワークが自社環境に合うかを判断するには、類似の業務課題を解いた実績を持つ開発会社との対話が有効です。

AI Marketでは、1,000件以上のAI導入相談実績をもとに要件を整理したうえで、プロンプト最適化に対応できる開発会社を1〜3営業日以内に無料で紹介しています。構想段階からの相談にも対応しており、一括見積もり型ではないため、不要な多重連絡が届く心配もありません。

LLM×RAGに強い会社の選定・紹介を行います

今年度RAG相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

完全無料・最短1日でご紹介 LLM×RAGに強い会社選定を依頼する

プロンプトを自動最適化する3つの運用上のメリット

プロンプトを自動的に最適化することで、以下のようなメリットがあります。

プロンプトを定量的に評価・比較できるようになる

プロンプトを自動最適化するメリットは、これまで担当者の感覚に委ねられていた出力品質の評価を、数値指標に基づいて行えるようになる点です。あらかじめ期待する出力(正解データ)と評価基準を定義しておくことで、複数のプロンプトを同一条件で実行し、精度・一貫性・網羅性といった観点から客観的に比較できます。

定量評価が可能になると「どのプロンプトが良いか」ではなく「どの変更がどの指標にどう影響したか」を把握できるようになります。

担当者が変わっても共通の基準で意思決定できるため、チーム開発や組織運用における属人化リスクを大きく低減できます。また、定量比較の蓄積によって、過去と現在のプロンプトを継続的にベンチマークし、性能劣化を早期に検知することも可能になります。

最適化の過程が記録され、説明責任を果たしやすくなる

自動最適化ツールをLangSmithのようなトレーシング基盤と組み合わせると、どのプロンプトが選ばれ、どのテストケースでなぜ失敗したかが分かる最適化の全過程をログとして保持できます。「なぜこのプロンプトになったのか」を事後に説明できる環境は、AI活用の社内説明責任やガバナンス体制の整備において重要な基盤になります。

経営層やコンプライアンス部門への報告、あるいは外部監査への対応を念頭に置く企業にとって、この「最適化の可視化・記録」は見落とされがちですが実用上の価値が高いメリットです。

LLMのアップデートへ体系的に追従できる

LLMは継続的に改良されており、モデルのバージョンアップや内部仕様の変更によって、同じプロンプトでも出力傾向が変わることがあります。手動運用では変化に気づいてから個別に対応する後手の構造になりがちです。

自動最適化の仕組みを整備していれば、モデル更新をトリガーとして再評価・再最適化のサイクルを自動で回すことができ、人が追従するのではなく仕組みとして追従させる体制を構築できます。

実際、JetBlueではDSPyを導入することで手動プロンプトチューニングを廃止し、モデルの評価指標を直接最適化する運用に移行しています。

また、DSPy v3.0(2025年6月リリース)では「Simbaオプティマイザー」が追加され、成功・失敗の実行例をLLM自身に比較・分析させながら最適化を進める機能が実装されています。複数ステップの推論タスクでSimbaを適用した際に正解率が47%から70%へ向上した事例も報告されており、ツール側の進化も急速に進んでいます。

こうした最新フレームワークを活用することで、モデルの進化を継続的な改善機会として取り込むことが現実的な選択肢になりつつあります。

代表的なプロンプト最適化ツール7選

プロンプト最適化を実務で進めるにあたっては、設計・評価・改善を支援する専用ツールの活用が不可欠です。各ツールは「プロンプト管理・可視化」「評価・テスト自動化」「自動最適化フレームワーク」という大きく3つの役割に分かれます。

自社の課題フェーズに合わせて選択・組み合わせることが現実的なアプローチです。どのツールから着手すべきか判断に迷う場合は、自社の開発体制・データ量・セキュリティ要件を整理したうえで、実績ある専門家の見立てを得ることが判断の精度を上げる方法の一つです。

AI Marketは、AI開発に特化したコンシェルジュサービスとして累計1,000件超の相談対応実績があり、ツール選定の相談から要件に合った開発会社の紹介まで一貫して無料でサポートしています。

DSPy

DSPyは、スタンフォード大学が開発したプロンプト自動最適化フレームワークです。人が直接プロンプトを書くのではなく、入出力の仕様と評価指標を定義し、それを満たすプロンプト構造をアルゴリズムによって自動生成・更新します。

2025年6月リリースのv3.0では、MIPROv2・SIMBA・GEPAという特性の異なるオプティマイザーが整備されており(、データ量やタスク複雑度に応じた使い分けが可能です。

| オプティマイザー | 最適化アプローチ | 向いているケース |

|---|---|---|

| MIPROv2 | 命令文とFew-shot例の両方をベイズ最適化で同時に探索 | データ量が中〜多めの場合。複雑なワークフローや詳細な推論が必要なタスク |

| SIMBA | 確率的ミニバッチサンプリングで出力ばらつきの大きいケースを特定し、LLM自身に失敗原因を分析させて自己改善ルールを生成 | 大規模データセットで体系的な改善を積み重ねたい場合 |

| GEPA | 遺伝的アルゴリズムとリフレクション(自己反省)を組み合わせた進化型最適化。LLMが実行軌跡を振り返り、成功・失敗を言語で分析しながらプロンプトを進化させる | 少量データでの高精度最適化。MIPROv2より少ないロールアウト数で高性能なプロンプト生成が可能 |

DSPyの最大の特徴は、プロンプトをブラックボックスとして扱わず、推論ステップや中間出力を含めたパイプライン全体を最適化対象にできる点です。モデルやバージョンが変わっても同じ評価指標で再最適化を回せるため、特定モデルへの依存を抑えた設計が可能です。

導入コストはやや高いものの、大規模・複雑なLLMシステムの本番運用において最も体系的な改善サイクルを実現できるツールとして、実績ある企業での採用が進んでいます。

OpenAI Prompt Optimizer

OpenAI Prompt Optimizerは、OpenAIが2025年8月にリリースした公式のプロンプト最適化ツールで、OpenAIダッシュボード上のPlaygroundから利用できます。元のプロンプトを入力してOptimizeボタンを押すだけで、モデルのベストプラクティスに基づいた改善案が生成され、変更箇所と改善理由が明示される設計になっています。

さらに、評価データセットと組み合わせることでよりきめ細かい最適化が可能です。

人によるアノテーション(良い/悪いの評価と詳細なコメント)やグレーダーの結果をもとに、モデルが最適なプロンプトを探索します。最適化されたプロンプトはPrompt Objectとして保存でき、APIコールでの再利用・バージョン管理・アプリケーション横断での共有が可能です。

GPT-5など最新モデルへの移行時にも有効で、既存のプロンプトをモデルの特性に合わせて効率的に更新できます。OpenAIのエコシステムを主軸に据えている開発環境との親和性が高いことが利点ですが、現時点ではOpenAIモデル以外への汎用性は限定的です。

PromptLayer

PromptLayerは、プロンプト管理と可観測性に特化したツールです。PromptLayer自体が最適なプロンプトを自動生成するわけではありません。

それでも、LLMへのリクエスト内容・レスポンス・バージョンを自動的に記録できるため、いつ・どのプロンプトが・どの結果を生んだかを追跡できます。

PromptLayerを導入することで、プロンプトをコードやモデルと同様に管理対象として扱えるようになり、属人的な調整から脱却しやすくなります。プロンプトのライブラリ化やチーム共有の起点として活用しやすく、組織的なプロンプト運用の第一歩として位置づけられます。

主な役割はログ取得・バージョン管理・評価の土台作りにあるため、本格的な自動最適化には評価基盤や他のツールとの組み合わせが必要です。

LangSmith

LangSmithは、LLMアプリケーションの挙動を可視化しながらプロンプト最適化を進められる開発・運用向けのプラットフォームです。チェーンやエージェントを含む処理フロー全体を対象に、入力・出力・中間結果を時系列で追跡できる点が特徴です。

どの入力に対してどのプロンプトが使われ、最終出力にどう影響したかを確認でき、精度低下や想定外の出力が発生した際も原因を特定しやすい設計になっています。

評価データセットを用いたテストや比較も可能で、改善効果を定量的に検証する基盤として機能します。前セクションで紹介したDSPyとの組み合わせにより、最適化の全過程を記録・説明できる環境も構築できます。

Langfuse

Langfuseは、LLMアプリケーションの観測・評価・プロンプト管理を一体的に扱えるオープンソースのエンジニアリングプラットフォームです。2025年6月には従来有料だった機能を含む全機能がOSSとして無料開放されています。

セルフホスティングも容易に行えるためデータを自社インフラ内で完結させたい企業にとって特に有力な選択肢です。

主な機能はトレーシング(入出力・コスト・レイテンシの記録)、プロンプトのバージョン管理とA/Bテスト、LLM-as-a-judgeによる自動評価と人手アノテーションの両立です。GitHubとの連携によってプロンプトをコードと同じレビュープロセスで管理し、問題発生時はUIから即座にロールバックできる運用体制を構築できます。

セキュリティ・コンプライアンスを重視する企業環境での採用実績も豊富です。

Helicone

HeliconeはLLM APIの利用状況を可視化し、プロンプト最適化の前提となる運用データを収集できるオブザーバビリティ系のツールです。OpenAIなどのAPI呼び出しをプロキシ経由で集約することで、プロンプト・レスポンス・レイテンシ・コストを自動記録できます。

現在は100以上のLLMプロバイダーに対応するAI Gatewayとしての機能も備えています。負荷分散・レート制限・レスポンスキャッシュといった運用機能を統合したオープンソースプラットフォームに進化しています。

特定のプロンプト変更がレスポンス品質やトークン消費量に与える影響を横断的に分析でき、改善判断の根拠をデータとして残せます。

Promptfoo

Promptfooは、プロンプトをソフトウェアテストの対象として体系的に評価・比較できるオープンソースのCLIツールです。あらかじめ定義したテストケースに対して複数のプロンプトやモデルを一括実行・比較できます。

そのため、プロンプト最適化を開発プロセスに組み込みやすい点が特徴です。

CI/CDパイプラインとの連携が容易で、プロンプト変更時の回帰テストやモデル切り替え時の性能比較に適しています。さらに、セキュリティテスト(red-teaming)機能を内蔵しており、プロンプトインジェクションなどのリスク検証も同一の仕組みで実施できます。

ローカル実行のためデータが外部に送信されず、機密情報を扱う業務環境での利用にも適しています。

LLM×RAGに強い会社の選定・紹介を行います

今年度RAG相談急増中!紹介実績1,000件超え!

・ご相談からご紹介まで完全無料

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

完全無料・最短1日でご紹介 LLM×RAGに強い会社選定を依頼する

プロンプト最適化を成功させる実務ポイント

プロンプト最適化はツール導入だけで終わってしまうと、実務で成果につなげることができません。

評価指標を定義する

プロンプト最適化を成功させるためには、何をもって良い出力とするのかを定義する必要があります。評価指標が曖昧なままでは主観的な改善に留まり、自動化の効果を十分に引き出せないため、業務要件に直結する観点で評価軸を整理しなければいけません。

- 正確性

- 網羅性

- 一貫性

- 応答時間

- トークン消費量

- 形式遵守率

- エラー発生率

これらを事前に定義することで、プロンプト改善の方向性が明確になります。

評価指標が定まると、どの指標がどの程度改善されたかを評価しながら進められるようになります。評価指標の定義とは、ツールによる自動最適化を機能させる前提条件であり、プロンプトを適切に管理するための基盤となります。

プロンプトを業務システムの一部として設計する

プロンプト最適化を機能させるには、プロンプトを業務システムの一要素として設計する視点が重要です。個人が都度調整する運用では、再現性や保守性に限界があり、業務規模の拡大とともに破綻しやすくなります。

具体的には、プロンプトをコードや設定ファイルと同様にバージョン管理し、どの業務フローで、どの条件下で使用されているかを確認できるようにします。また、RAGや外部APIと分離して設計することで、プロンプトの改善がシステム全体に与える影響を把握しやすくなります。

このように設計することで、モデル変更や業務要件の追加が発生しても、プロンプトだけを局所的に見直すことが可能です。

チームで共有可能な形にする

プロンプト最適化を属人的な取り組みで終わらせないためには、チームで共有・再利用できる形に整備することが必須です。特定の担当者しか理解できないプロンプトや評価指標では改善ノウハウが蓄積されません。

具体的には、プロンプトの以下の要素を明文化し、他のメンバーが見ても意図を理解できる状態にします。

- 目的

- 前提条件

- 評価指標

- 想定する入出力

- 変更履歴

- 評価結果

これらの要素を合わせて管理することで、なぜこのプロンプトが採用されているのかを説明できるようになります。これにより、レビューや合意形成もスムーズに進みます。

チームで共有可能な形にすることは、プロンプトを組織の資産として扱うための取り組みとして欠かせません。

改善サイクルを回せる設計にする

プロンプト最適化を一過性の施策で終わらせない方法としては、改善サイクルを継続的に回せる設計が欠かせません。初期段階で一定の精度が出たとしても、業務要件の変化やLLMの更新によって最適なプロンプトは時間とともに変化します。

サイクルを確立するには、評価・比較・改善を定期的に実行できる仕組みを組み込む必要があります。テストデータや評価指標を固定化し、プロンプト変更時には必ず再評価が走るようにすることで出力精度の劣化を早期に検知できます。

このような改善サイクルが回る設計では、プロンプトは完成形ではなく、継続的に更新される前提の資産として扱われます。

プロンプト最適化についてよくある質問まとめ

- 手動でプロンプトを改善し続けるとき、どのような問題が顕在化するのか?

主に4つの問題があります。

- 再現性の欠如:判断基準が暗黙知化し、担当者交代や環境変更で同じ品質を再現できなくなる

- 検証コストの膨張:テキストの小さな変更でも毎回人手による実行・目視確認が必要で、ユースケースが増えるほど負担が拡大する

- モデル依存:高性能モデル向けに調整されたプロンプトは、軽量・高速モデルへの移行時に精度を維持できない

- 主観的評価:評価軸が定義されないまま改善が進み、何が効果的だったかを客観的に説明できないケースが生じる

- プロンプト最適化を自動で行うメリットは?

主に3つのメリットがあります。

- 定量的な評価・比較:精度・一貫性・網羅性などを数値で比較でき、担当者の主観に依存しない意思決定が可能になる

- 説明責任の確保:最適化の全過程がログとして記録され、「なぜこのプロンプトになったのか」を事後に説明できる環境が整う

- LLMアップデートへの体系的な追従:モデル更新をトリガーに再評価・再最適化サイクルを自動で回せるため、変化への対応が後手に回らない

- プロンプト最適化を可能にするツールは?

プロンプト最適化を支援するツールとしては、以下の7つが代表的です。

- PromptLayer

- LangSmith

- Humanloop

- Helicone

- Promptfoo

- OpenAI Prompt Optimizer

- DSPy

- 自社の開発体制や業務要件に合ったプロンプト最適化ツールを、どう選べばいいのか?

ツール選定は「現在の課題フェーズ」によって異なります。まず可視化から始めたい場合はPromptLayerやHelicone、評価・改善基盤が必要な段階ではLangSmithやLangfuse、自動最適化まで踏み込む場合はDSPyまたはOpenAI Prompt Optimizerが候補になります。ただし、自社のシステム構成・データ管理要件・開発リソースによって適切な選択は異なるため、類似案件の実績を持つ専門家への相談が実質的な判断の近道です。

AI Marketでは累計1,000件以上の相談対応実績をもとに、要件整理の段階から対応しており、1〜3営業日で自社状況に合った開発会社を無料で紹介しています。構想が固まる前の段階からでも相談可能です。

- プロンプト最適化の導入にかかる工数・費用感の目安はどのくらいか?

アプローチによって大きく異なります。構造化プロンプト設計やPromptLayerのような管理ツールの導入は比較的低コストで着手できます。一方、DSPyによる自動最適化パイプラインの本番構築には、テストケース整備・評価指標設計・インフラ構成の検討が必要で、エンジニアの工数が相応に発生します。

OpenAI Prompt OptimizerはPlaygroundからすぐ試せますが、OpenAIエコシステム外への汎用性は限定的です。自社の規模・要件・AI開発体制に合った進め方の費用感を把握するには、類似案件の実績を持つ専門家への相談が有効です。AI Marketは完全無料で利用でき、紹介後に希望した会社以外から連絡が届くことはないため、情報収集・比較検討の段階から気軽に活用できます。

まとめ

プロンプト最適化は、生成AIを業務で安定的・継続的に活用するための基盤となります。従来のように人の経験や勘に依存した手動改善では、再現性やスケーラビリティに限界があり、生成AIを本格的な業務システムへと昇華させることは困難です。

一方で、DSPyのような自動最適化フレームワークの本番導入や、自社の業務要件に合った評価指標の設計には、LLMアプリケーション開発の実務経験が必要です。どのツールから着手すべきか、自社の開発体制にどのアプローチが合うかの判断に迷う場合は類似案件の実績を持つ専門家への相談が実質的な近道になります。

AI Marketでは、累計1,000件以上のAI導入相談実績をもとに、プロンプト最適化を含む生成AI活用の要件整理から対応可能な開発会社の紹介まで無料でサポートしています。構想がまだ固まっていない段階でも相談を受け付けていますので、まず現状の課題を言語化するところから始めてみてください。

AI Market 運営、BizTech株式会社 代表取締役|2021年にサービス提供を開始したAI Marketのコンサルタントとしても、お客様に寄り添いながら、現場のお客様の課題ヒアリングや企業のご紹介を5年以上実施しています。これまでにLLM・RAGを始め、画像認識、データ分析等、1,000件を超える様々なAI導入相談に対応し、参加累計5,000人を超えるAIイベントを主催。AIシステム開発PM歴8年以上。AI Marketの記事では、AIに関する情報をわかりやすくお伝えしています。(JDLA GENERAL 資格保有)

AI Market 公式𝕏:@AIMarket_jp

Youtubeチャンネル:@aimarket_channel

TikTok:@aimarket_jp

運営会社:BizTech株式会社

掲載記事に関するご意見・ご相談はこちら:ai-market-contents@biz-t.jp