AirPodsのライブ翻訳とは?iPhone搭載の自動音声翻訳の特徴・機能、使い方、注意点まで徹底解説!

最終更新日:2025年11月10日

記事監修者:森下 佳宏|BizTech株式会社 代表取締役

- Apple Intelligenceによるリアルタイム翻訳機能が日本語、中国語、韓国語に対応し、ハンズフリーで異なる言語話者との自然な会話が可能

- AirPods Pro 2以降とANC搭載AirPods 4が対応し、翻訳処理はオンデバイスで実行されプライバシーを保護

- iPhone 15 Pro以降のデバイスで利用可能で、旅行、ビジネス、教育など多様な場面での活用が期待される

Apple社が発表したAirPodsのライブ翻訳は、Apple Intelligenceを活用したAirPodsのリアルタイム翻訳機能です。2025年11月4日に「iOS 26.1」のリリースと共に正式に日本語対応も発表されました。

異なる言語を話す人々が自然に会話できるように設計されています。翻訳処理はすべてデバイス上で行われるため、プライバシーが保たれたままリアルタイムで翻訳を聞くことが可能です。

本記事では、AirPods ライブ翻訳の特徴・主な機能、使える機種と使い方、注意点まで詳しく解説します。

音声認識に強いAI会社の選定・紹介を行います 今年度AI相談急増中!紹介実績1,000件超え! ・ご相談からご紹介まで完全無料 完全無料・最短1日でご紹介 音声認識に強いAI会社選定を依頼する

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

目次

AirPodsのライブ翻訳とは?

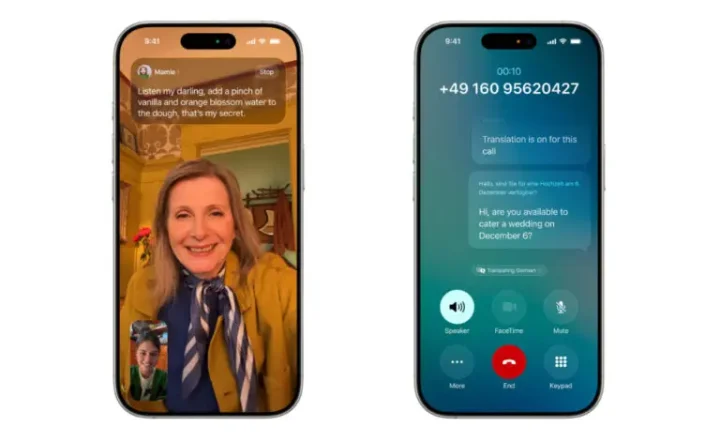

AirPodsライブ翻訳は、iPhoneとAirPodsを組み合わせることで、「翻訳」アプリ、電話、FaceTimeで話している相手の言葉をリアルタイムで翻訳し、自分の言語で聞くことができる機能です。iPhone側でApple Intelligenceをオンにすること、そして、AirPods Pro 2、AirPods Pro 3、アクティブノイズキャンセリング(ANC)搭載AirPods 4が必要になります。

翻訳処理はApple Intelligenceによってオンデバイスで実行されるため、会話内容が外部サーバに送信されることはありません。

2025年11月上旬に日本語、中国語(北京語)、韓国語への対応が発表されました。

音声認識に強いAI会社の選定・紹介を行います 今年度AI相談急増中!紹介実績1,000件超え! ・ご相談からご紹介まで完全無料 完全無料・最短1日でご紹介 音声認識に強いAI会社選定を依頼する

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

AirPodsライブ翻訳の特徴・主な機能

AirPodsライブ翻訳には、会話をよりスムーズにするためのさまざまな仕組みや技術が搭載されています。主な特徴と機能は以下のとおりです。

ハンズフリーで使えるリアルタイム翻訳機能

両方のユーザーが対応するAirPodsを装着し、iPhoneでApple Intelligenceとライブ翻訳を有効にしている場合、それぞれが自分の言語で話しても、相手の言葉をリアルタイムで自分の言語に翻訳して聞くことができます。

たとえば、日本語を話すユーザーが英語を話す相手と会話する場合、相手の英語は瞬時に日本語に翻訳され、AirPodsから自然に再生されます。

この体験は、音声認識、ニューラル機械翻訳、TTS(音声合成)という複数のAIモデルが、コンマ数秒の遅延でシームレスに連携することで初めて成立します。

ハードウェア(AirPodsのマイク、iPhoneのチップ)とソフトウェア(iOS、翻訳アプリ、Apple Intelligence)を統合開発するAppleだからこそ実現できたUX(ユーザー体験)」と言えます。

従来の「スマホのマイクに交互に話しかける」というプロセスから脱却し、言語の違いを意識せず、スムーズで自然な対話を行うことができます。

プライバシー保護のためのオンデバイス処理

翻訳はすべてデバイス上で行われ、音声や会話内容が外部サーバに送信されません。従来のAI翻訳の多くは、音声を一度クラウド(サーバー)に送信し、処理・翻訳してからデバイスに返す方式でした。

しかし、AppleはApple Intelligenceの中核として、iPhone本体のチップ(Apple Neural Engine)上でAI処理を完結させる「オンデバイスAI」(エッジAI)を徹底しています。

個人情報を守りながら安心して利用できる設計になっています。

ANCと音声認識による高精度な聞き取り

AirPods Proは、単なるイヤホンではなく、高度な「耳」として機能します。アクティブノイズキャンセリング(ANC)とApple Intelligenceによる高度な音声認識(ASR)が連携し、相手の声を明瞭に捉えつつ翻訳音声をクリアに再生します。

この「入力精度」が、翻訳全体の質を支える土台となります。騒音の多い環境でも会話を中断することなく続けることができます。

多様な操作方法

翻訳アプリの「ライブ」タブから、入力言語と出力言語を選択して翻訳を開始できます。会話内容は文字起こしとして画面上に表示され、必要に応じて再生ボタンで音声を再生することも可能です。

また、AirPodsのステムを長押しして翻訳を開始できるほか、「Hey Siri、ライブ翻訳を開始して」と呼びかけたり、iPhoneのコントロールセンターやアクションボタンからも簡単に起動することができます。

参考:Apple公式発表

AirPodsライブ翻訳の使えるアプリ・機種

以下に、iPhoneでApple Intelligenceが使える機種と、AirPodsでライブ翻訳に対応しているモデルを一覧でまとめています。 どちらも、対応している組み合わせで使用することでハンズフリーのリアルタイム翻訳が可能になります。

AirPodsライブ翻訳播種用アプリに対応

ライブ翻訳は、メッセージ、電話、FaceTimeなどAppleの主要アプリに統合されており、チャットや通話中でもリアルタイム翻訳を利用することができます。

Apple Intelligence対応デバイス・システム条件一覧

以下の表では、Apple Intelligenceを利用できるすべてのデバイスと必要なシステム条件をまとめています。結果として、iPhone 15 Pro以降でApple Intelligenceが利用できます。

| デバイス名 | Apple Intelligence対応 | 必要OS / システム条件 |

|---|---|---|

| iPhone 14まで (15 / 15 Plus含む) | ✕ | ― |

| iPhone 15 Pro以降 | ◯ | iOS 18.1以降 |

| iPad mini (A17 Pro搭載モデル) | ◯ | iPadOS 18.1以降 |

| iPad (M1以降搭載モデル) | ◯ | iPadOS 18.1以降 |

| Mac (M1以降搭載モデル) | ◯ | macOS Sequoia 15.1以降 |

| Apple Vision Pro | ◯ | visionOS 2.4以降 |

| Apple Watch Series 6以降 | ◯ | watchOS 11以降 (対応iPhoneとのペアリングが必要) |

| Apple Watch Ultra (全モデル) | ◯ | watchOS 11以降 (対応iPhoneとのペアリングが必要) |

| Apple Watch SE (第2世代以降) | ◯ | watchOS 11以降 (対応iPhoneとのペアリング・近接が必要) |

参考:https://support.apple.com/ja-jp/121115

AirPodsでのライブ翻訳対応状況

以下の表では、AirPodsシリーズごとにライブ翻訳機能が使えるかどうかをまとめた一覧です。

結果として、AirPods Pro(第2世代以降)およびアクティブノイズキャンセリング搭載AirPods 4でライブ翻訳が利用できます。

| AirPodsモデル | ライブ翻訳機能対応 |

|---|---|

| AirPods (第3世代まで) | ✕ |

| AirPods 4 | ✕ |

| AirPods 4 (アクティブノイズキャンセリング搭載) | ◯ |

| AirPods Pro (第2世代以降) | ◯ |

| AirPods Max | ✕ |

音声認識に強いAI会社の選定・紹介を行います 今年度AI相談急増中!紹介実績1,000件超え! ・ご相談からご紹介まで完全無料 完全無料・最短1日でご紹介 音声認識に強いAI会社選定を依頼する

・貴社に最適な会社に手間なく出会える

・AIのプロが貴社の代わりに数社選定

・お客様満足度96.8%超

AirPods ライブ翻訳の使い方

- iPhoneの設定アプリを開き、「Apple IntelligenceとSiri」をオンにします。

- AirPodsを装着し、iPhoneに接続されていることを確認します。

- 翻訳アプリを開き、「ライブ」タブから入力言語と出力言語を選択します。

- 両方のAirPodsのステムを長押し、またはSiriに「ライブ翻訳を開始して」と頼むことで翻訳を開始します。

- 翻訳が始まると適応型オーディオが自動的に有効になり、相手の言葉を優先する言語にリアルタイムで翻訳して再生します。

相手が対応AirPodsを使っている場合は、両者がそれぞれ自分の言語で話しながら、翻訳された音声を聞くことができます。

使う上での注意点

ライブ翻訳を利用するには、iPhone 15 Proモデル以降でApple Intelligenceがオンになっている必要があり、AirPodsには最新のファームウェアが搭載されている必要があります。

機能は国や地域によって利用できない場合があります。特にEU圏ではAirPodsでのライブ翻訳機能が提供されておらず、中国本土でも現時点では利用できません。

AirPodsライブ翻訳に関するよくある質問まとめ

- AirPodsライブ翻訳を利用するにはどのデバイスが必要か?

iPhone 15 Pro以降のデバイスでiOS 18.1以降が必要となる。AirPodsは、AirPods Pro(第2世代以降)またはアクティブノイズキャンセリング搭載AirPods 4が対応している。

iPhoneでApple Intelligenceを有効にし、AirPodsに最新のファームウェアがインストールされている必要がある。

- AirPodsライブ翻訳で会話内容のプライバシーは保護されるのか?

翻訳処理はすべてApple Intelligenceによってオンデバイスで実行されるため、音声や会話内容が外部サーバに送信されることはない。

ネットワーク接続なしでも動作し、個人情報を守りながら安心して利用できる設計となっている。

まとめ

AirPodsのライブ翻訳は、Apple IntelligenceとAirPodsの高度なオーディオ処理技術を融合し、異なる言語を話す人々の自然なコミュニケーションを可能にする機能です。

リアルタイム翻訳がハンズフリーで行えるため、旅行や教育、ビジネスなど幅広い場面で活用することができます。翻訳はすべてデバイス上で処理され、プライバシーも確保されています。

一方で、地域による制限や対応デバイス、ファームウェアの要件などがあり、正式版へのアップデートで今後さらに機能が拡張されることが期待されています。

AirPodsのライブ翻訳(特に日本語対応)は、AIが日常とビジネスの境界を溶かし始めたことを示す象徴的な出来事です。これは「音声AI」という巨大なトレンドの、ほんの入り口に過ぎません。

重要なのは、この技術を単なる「効率化ツール」として傍観するのではなく、自社のビジネスモデルやオペレーション、顧客体験(CX)を根底から見直す実現手段として捉え直すことです。

AI Market 運営、BizTech株式会社 代表取締役|2021年にサービス提供を開始したAI Marketのコンサルタントとしても、お客様に寄り添いながら、現場のお客様の課題ヒアリングや企業のご紹介を5年以上実施しています。これまでにLLM・RAGを始め、画像認識、データ分析等、1,000件を超える様々なAI導入相談に対応し、参加累計5,000人を超えるAIイベントを主催。AIシステム開発PM歴8年以上。AI Marketの記事では、AIに関する情報をわかりやすくお伝えしています。(JDLA GENERAL 資格保有)

AI Market 公式𝕏:@AIMarket_jp

Youtubeチャンネル:@aimarket_channel

TikTok:@aimarket_jp

運営会社:BizTech株式会社

掲載記事に関するご意見・ご相談はこちら:ai-market-contents@biz-t.jp